Spark系列之Spark启动与基础使用-程序员宅基地

title: Spark系列

第三章 Spark启动与基础使用

3.1 Spark Shell

3.1.1 Spark Shell启动

安装目录的bin目录下面,启动命令:

spark-shell

$SPARK_HOME/bin/spark-shell \

--master spark://hadoop10:7077 \

--executor-memory 512M \

--total-executor-cores 2

注意上面的 cores 参数,若是 0,那么以后这个 spark shell 中运行的代码是不能执行成功的。千万注意。必要要把 cpu cores 和 memory 设置合理。

1、executor memory不能超过虚拟机的内存

2、cpu cores不要超过spark集群能够提供的总cpu cores,否则会使用全部。最好不要使用全部。否则其他程序由于没有cpu core可用,就不能正常运行

参数说明:

--master spark://hadoop10:7077 指定Master的地址

--executor-memory 2G 指定每个worker可用内存为2G

--total-executor-cores 2 指定整个集群使用的cpu核数为2个

注意:

如果启动spark shell时没有指定master地址,但是也可以正常启动spark shell和执行spark shell中的程序,其实是启动了spark的local模式,该模式仅在本机启动一个Driver进程,没有与集群建立联系。

Spark-2.x开始/Spark3.x

Spark Shell 中已经默认将 SparkContext 类初始化为对象 sc

Spark Shell 中已经默认将 SparkSession 类初始化为对象 spark

用户代码如果需要用到,则直接应用 sc,spark 即可

Spark-1.x

Spark Shell 中已经默认将 SparkContext 类初始化为对象 sc

Spark Shell 中已经默认将 SQLContext 类初始化为对象 sqlContext

用户代码如果需要用到,则直接应用sc,sqlContext即可

3.1.2 编写WordCount

在提交WordCount程序之前,先在HDFS集群中的准备一个文件用于做单词统计:

words.txt内容如下:

hello huangbo

hello xuzheng

hello wangbaoqiang

把该文件上传到HDFS文件系统中:

hadoop fs -mkdir -p /spark/wc/input

hadoop fs -put words.txt /spark/wc/input

在 Spark Shell 中提交 WordCount 程序:

sc.textFile("hdfs://hadoop10/spark/wc/input/words.txt").flatMap(_.split(" ")).map((_,1)).reduceByKey(_+_).saveAsTextFile("hdfs://hadoop10/spark/wc/output")

查询验证结果:

hadoop fs -ls hdfs://hadoop10/spark/wc/output

hadoop fs -cat hdfs://hadoop10/spark/wc/output/*

说明:

sc

.textFile("hdfs://hadoop10/spark/wc/input/words.txt")

.flatMap(_.split(""))

.map((_,1))

.reduceByKey(_+_)

.saveAsTextFile("hdfs://hadoop10/spark/wc/output")

1、sc

是SparkContext对象,该对象时提交spark程序的入口

2、textFile("hdfs://hadoop10/spark/wc/input/words.txt")是从HDFS中读取数据

底层是通过InputFormat去读取(因为数据在HDFS,从HDFS读取数据的规范就是InputFormat)

RDD[String] (文件中的一行,就是RDD中的一条数据。)

3、flatMap(_.split(" "))

先map,再压平,切割压平

Array(Array("hello", "a"), Array("hello", "b")) =》 Array("hello", "a","hello", "b")

4、map((_,1))

将单词和1构成元组(word,1)

5、reduceByKey(_+_)

按照key进行reduce,并将value累加

6、saveAsTextFile("hdfs://hadoop10/spark/wc/output")

将结果写入到HDFS对应输出目录中

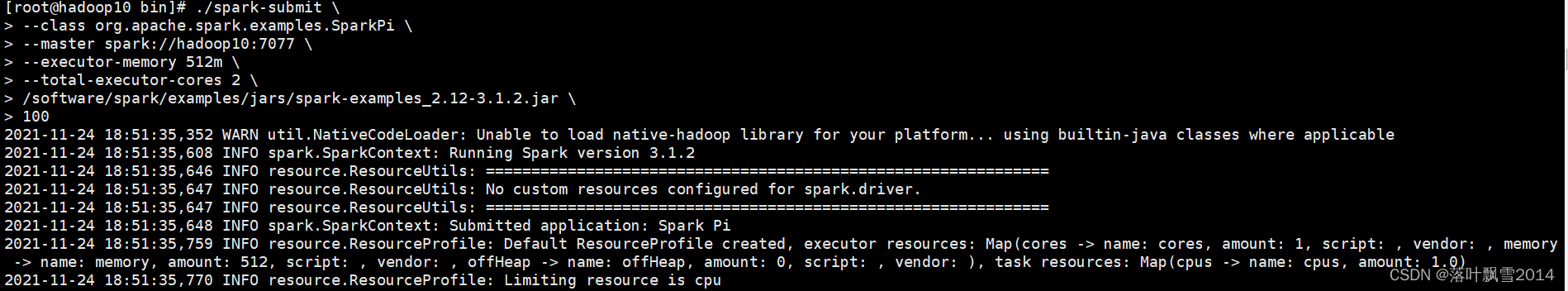

3.2 Spark Submit

利用Spark自带的例子程序执行一个求PI(蒙特卡洛算法)的程序:

[root@hadoop10 bin]# ./spark-submit \

--class org.apache.spark.examples.SparkPi \

--master spark://hadoop10:7077 \

--executor-memory 512m \

--total-executor-cores 2 \

/software/spark/examples/jars/spark-examples_2.12-3.1.2.jar \

100

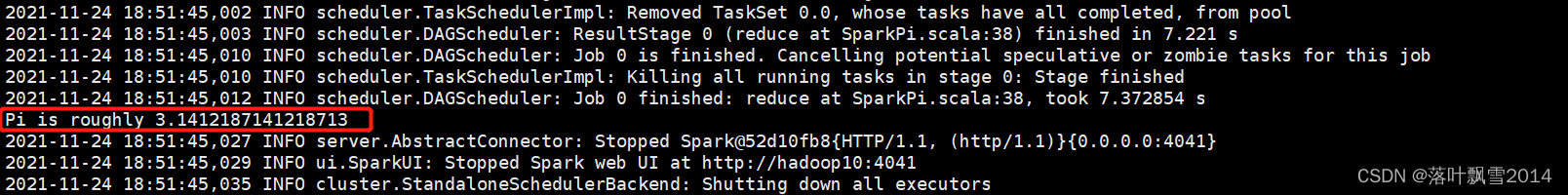

运行结果:

理解:

执行通过/software/spark/bin/spark-shell来运行。

如果不设置master那么默认运行在本机节点;

如果设置 --master spark://hadoop10:7077,那么运行在Spark Standalone模式集群。

参数说明:

--class 指定 jar 包的主类

--master 指定jar包提交的模式

详解如下:

1、local

本地模式,本地运行,可以调试(local 1个线程、local[*]不限线程、local[N] N个线程,理想情况下,N设置为你机器的CPU核数)

2、spark

提交到Spark Standalone集群,有Master和Worker进程

3、mesos

将jar包提交到mesos集群,运行在mesos资源管理器框架之上,由mesos负责资源管理,Spark负责任务调度和计算

4、YARN

将jar包提交到yarn集群,运行在yarn资源管理器框架之上,由yarn负责资源管理,Spark负责任务调度和计算

5、cloud

比如AWS的EC2,使用这个模式能很方便的访问Amazon的S3,Spark支持多种分布式存储系统,比如HDFS和S3

--deploy-mode 指定jar的运行方式(默认是 client 模式)

详解如下:

1、client 模式

在提交端生成的JVM会一直等待所有计算过程全部完成才退出,它有两个功能,一个是提交,一个是监控jar包运行(测试环境下使用)

2、cluster 模式

在提交端生成的JVM在提交jar包后会退出,它只有一个提交功能,然后在某一个 worker上会生成一个Driver的JVM,该JVM执行监控jar包运行的功能,等待所有代码运行完毕退出(生产环境下使用 )

application.jar 指定你的jar包的地址

arguments 传递给main()方法的参数

3.2.1 Spark Submit多种运行模式

1、提交任务到本地运行

/software/spark/bin/spark-submit \

--class org.apache.spark.examples.SparkPi \

--master local[4] \

--driver-memory 512m \

--executor-memory 512m \

--total-executor-cores 1 \

/software/spark/examples/jars/spark-examples_2.12-3.1.2.jar \

10

2、提交任务到Spark集群运行

/software/spark/bin/spark-submit \

--class org.apache.spark.examples.SparkPi \

--master spark://hadoop10:7077 \

--driver-memory 512m \

--executor-memory 512m \

--total-executor-cores 1 \

/software/spark/examples/jars/spark-examples_2.12-3.1.2.jar \

10

3、提交Yarn集群,使用Yarn-Client模式

/software/spark/bin/spark-submit \

--class org.apache.spark.examples.SparkPi \

--master yarn \

--deploy-mode client \

--driver-memory 512m \

--executor-memory 512m \

--total-executor-cores 1 \

/software/spark/examples/jars/spark-examples_2.12-3.1.2.jar \

10

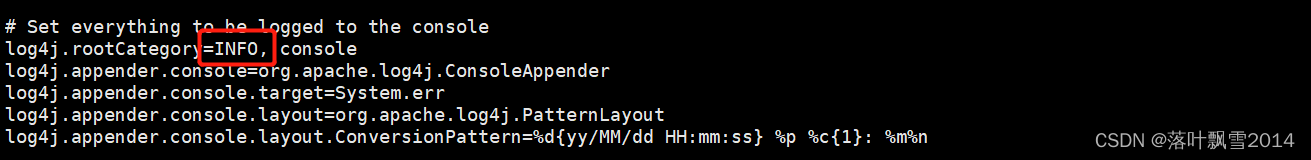

3.3 修改Spark日志级别

3.3.1 临时修改

val sparkContext:SparkContext = new SparkContext(conf)

sparkContext.setLogLevel("WARN")

3.3.2 永久修改

可以通过修改Spark配置文件来Spark日志级别

以下是详细步骤的:

第一步:先进入conf目录

[root@hadoop10 conf]$ cd /software/spark/conf

第二步:准备log4j.properties

[root@hadoop10 conf]$ cp log4j.properties.template log4j.properties

第三步:配置日志级别:

把INFO改成你想要的级别:主要有ERROR, WARN, INFO, DEBUG几种

3.4 Spark的WordCount案例

3.4.0 spark-shell中的WordCount

[root@hadoop10 bin]# cd /software/spark/bin/

[root@hadoop10 bin]# pwd

/software/spark/bin

[root@hadoop10 bin]# spark-shell

2021-11-09 16:57:03,855 WARN util.NativeCodeLoader: Unable to load native-hadoop library for your platform... using builtin-java classes where applicable

Setting default log level to "WARN".

To adjust logging level use sc.setLogLevel(newLevel). For SparkR, use setLogLevel(newLevel).

Spark context Web UI available at http://hadoop10:4040

Spark context available as 'sc' (master = local[*], app id = local-1636448230277).

Spark session available as 'spark'.

Welcome to

____ __

/ __/__ ___ _____/ /__

_\ \/ _ \/ _ `/ __/ '_/

/___/ .__/\_,_/_/ /_/\_\ version 3.1.2

/_/

Using Scala version 2.12.10 (Java HotSpot(TM) 64-Bit Server VM, Java 1.8.0_202)

Type in expressions to have them evaluated.

Type :help for more information.

scala> sc.textFile("file:///home/data/wordcount.txt").flatMap(_.split(" ")).map((_,1)).reduceByKey(_+_).foreach(println)

(hadoop,1) (0 + 2) / 2]

(hbase,1)

(hello,3)

(world,1)

scala>

3.4.1 Java7版本WordCount

package com.aa.sparkjava.core.wordcount;

import org.apache.spark.SparkConf;

import org.apache.spark.api.java.JavaPairRDD;

import org.apache.spark.api.java.JavaRDD;

import org.apache.spark.api.java.JavaSparkContext;

import org.apache.spark.api.java.function.FlatMapFunction;

import org.apache.spark.api.java.function.Function2;

import org.apache.spark.api.java.function.PairFunction;

import org.apache.spark.api.java.function.VoidFunction;

import scala.Tuple2;

import java.util.Arrays;

import java.util.Iterator;

/**

* @Author AA

* @Date 2021/11/25 16:46

* @Project bigdatapre

* @Package com.aa.sparkjava.core.wordcount

* WordCountJava java7版本的编写

*/

public class WordCountJava7 {

public static void main(String[] args){

//一、参数判断

if(args.length!=2){

System.out.println("Usage:JavaWordCount7: Please enter the necessary parameters:<input><output>");

System.exit(1);

}

//二、编程入口

SparkConf conf = new SparkConf();

conf.setMaster("local");

conf.setAppName(WordCountJava7.class.getSimpleName());

JavaSparkContext jsc = new JavaSparkContext(conf);

//三、读取数据,设置输入路径。

JavaRDD<String> lineRDD = jsc.textFile(args[0]);

//四、进行逻辑处理,切割压平

JavaRDD<String> jrdd1 = lineRDD.flatMap(new FlatMapFunction<String, String>() {

@Override

public Iterator<String> call(String line) throws Exception {

return Arrays.asList(line.split(" ")).iterator();

}

});

//五、将四中的单词结果和1组合成元组

JavaPairRDD<String, Integer> javaPairRDD = jrdd1.mapToPair(new PairFunction<String, String, Integer>() {

@Override

public Tuple2<String, Integer> call(String s) throws Exception {

return new Tuple2<String, Integer>(s, 1);

}

});

//六、 分组聚合 reduceByKey() (a,b)=>a+b 前两个参数是输入参数类型,第三个参数:返回值的类型

JavaPairRDD<String, Integer> result = javaPairRDD.reduceByKey(new Function2<Integer, Integer, Integer>() {

@Override

public Integer call(Integer v1, Integer v2) throws Exception {

return v1 + v2;

}

});

//七、保存结果或者打印输出

//打印输出

result.foreach(new VoidFunction<Tuple2<String, Integer>>() {

@Override

public void call(Tuple2<String, Integer> tuple) throws Exception {

System.out.println(tuple);

//System.out.println(tuple._1 + " " + tuple._2);

}

});

//保存结果

//result.saveAsTextFile(args[1]);

//八、释放资源

jsc.close();

}

}

3.4.2 Java8 Lambda表达式版本WordCount

package com.aa.sparkjava.core.wordcount;

import org.apache.spark.SparkConf;

import org.apache.spark.api.java.JavaPairRDD;

import org.apache.spark.api.java.JavaRDD;

import org.apache.spark.api.java.JavaSparkContext;

import scala.Tuple2;

import java.util.Arrays;

/**

* @Author AA

* @Date 2021/11/26 11:53

* @Project bigdatapre

* @Package com.aa.sparkjava.core.wordcount

* WordCountJava java8版本 使用lambda表达式

*/

public class WordCountJava8 {

public static void main(String[] args){

if(args.length != 2){

System.out.println("Please enter the necessary parameters:Usage Java8 Lambda WordCount<input><output>");

System.exit(1);

}

SparkConf conf = new SparkConf();

conf.setMaster("local");

conf.setAppName(WordCountJava8.class.getSimpleName());

JavaSparkContext jsc = new JavaSparkContext(conf);

//1、读取数据

JavaRDD<String> jrdd = jsc.textFile(args[0]);

//2、切割压平

JavaRDD<String> jrdd2 = jrdd.flatMap(t -> Arrays.asList(t.split(" ")).iterator());

//3、和1组合

JavaPairRDD<String, Integer> jprdd = jrdd2.mapToPair(t -> new Tuple2<String, Integer>(t, 1));

//4、分组聚合

JavaPairRDD<String, Integer> res = jprdd.reduceByKey((a, b) -> a + b);

//5、保存输出

res.saveAsTextFile(args[1]);

//6、释放资源

jsc.close();

}

}

3.4.3 Scala版本WordCount

package com.aa.sparkscala.core.wordcount

import org.apache.spark.rdd.RDD

import org.apache.spark.{

SparkConf, SparkContext}

/**

* @Author AA

* @Date 2021/11/26 15:08

* @Project bigdatapre

* @Package com.aa.sparkscala.core.wordcount

* Spark WordCount Scala版本 使用老的API SparkContext

*/

object WordCountScala {

def main(args: Array[String]): Unit = {

//1、创建一个SparkConf对象,并设置程序的名称

val conf = new SparkConf().setAppName("WordCount").setMaster("local")

//2、创建一个SparkContext对象

val sparkContext: SparkContext = new SparkContext(conf)

//3、读取HDFS上的文件构建一个RDD

val fileRDD: RDD[String] = sparkContext.textFile("D:\\input\\test1.txt")

//4、构建一个单词RDD

val wordAndOneRDD: RDD[(String, Int)] = fileRDD.flatMap(_.split(" ")).map((_, 1))

//5、进行单词的聚合

val resultRDD: RDD[(String, Int)] = wordAndOneRDD.reduceByKey(_ + _)

//6、保存结果

resultRDD.saveAsTextFile("D:\\output\\wordcountscala1")

//7、关闭sc

sparkContext.stop()

}

}

3.4.4 补充API依赖

<dependency>

<groupId>org.scala-lang</groupId>

<artifactId>scala-library</artifactId>

<version>2.12.14</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.12</artifactId>

<version>3.1.2</version>

</dependency>

声明:

文章中代码及相关语句为自己根据相应理解编写,文章中出现的相关图片为自己实践中的截图和相关技术对应的图片,若有相关异议,请联系删除。感谢。转载请注明出处,感谢。

By luoyepiaoxue2014

B站: https://space.bilibili.com/1523287361 点击打开链接

微博地址: http://weibo.com/luoyepiaoxue2014 点击打开链接

智能推荐

log4cplus 使用方法 配置_log4cplus::helpers::properties::setproperty设置行号-程序员宅基地

文章浏览阅读2.5k次。转自https://my.oschina.net/lovecxx/blog/185951Log4cplus使用指南1. Log4cplus简介log4cplus是C++编写的开源的日志系统,前身是java编写的log4j系统,受Apache Software License保护,作者是Tad E. Smith。log4cplus具有线程安全、灵活、以及多粒度控制的特点,通过将日志..._log4cplus::helpers::properties::setproperty设置行号

phpstudy安装+配置站点_phpstudy20161103 域名配置文件-程序员宅基地

文章浏览阅读994次,点赞4次,收藏10次。phpstudy安装+配置站点软件下载地址:http://phpstudy.php.cn/phpstudy/phpStudy20161103.zip本人推荐使用phpstudy2016版本 主要是稳定 没有杂七杂八的文件下载软件安装好咱们就直接开始配置站点首先我们先打开站点域名管理Doesn’t the thought of “Artificial Intelligence” (AI) sound exciting??? It’s all the rage now. As technology and human skills are progressing, people from ..._in the case of multivariate linear regression, we have to predict instead of

基于51单片机的HX711传感器电子秤设计_hx711 电子秤 51单片机-程序员宅基地

文章浏览阅读359次。***********************lcd1602上显示这字符函数************************//***********************lcd1602初始化设置************************/sbit rs=P1^0;/******1ms延时函数***12M晶振**************/////////////////在指定位置显示指定字符//////////sbit e =P1^2;_hx711 电子秤 51单片机

Qt 错误提示1: invalid use of incomplete type ‘***‘-程序员宅基地

文章浏览阅读2.5k次。invalid use of incomplete type ‘***’出现此类错误的原因一般都是没有使用类的头文件。可以通过查询类的头文件,将其包含进来即可。1.查询类的头文件通过鼠标放在QMouseEvent类上按F1j即可自动跳转到如下图的帮助文档。2.确认头文件并将其包含进来..._invalid use of incomplete type

vite配置@别名,以及如何让vscode智能提示路经_vite+js项目配置路径别名后不自动提示-程序员宅基地

文章浏览阅读348次。【代码】vite配置@别名,以及如何让vscode智能提示路经。_vite+js项目配置路径别名后不自动提示

随便推点

linux系统中解压缩zip文件_linux能解压zip文件吗-程序员宅基地

文章浏览阅读1.8w次,点赞21次,收藏88次。其中,file.zip是需要解压的zip文件的文件名,-d选项用于指定解压文件的目标路径,target_dir是目标路径的名称。回车后,将开始解压文件。解压完成后,你将在target_dir中找到解压后的文件。_linux能解压zip文件吗

lstm多输入时间序列预测_梯度阈值等于1说明什么-程序员宅基地

文章浏览阅读2.2k次,点赞6次,收藏45次。lstm 多输入时间序列预测clcclose allclear all%加载数据,重构为行向量load data.matIN_train = data((1:4197),2:9)';OUT_train = data((1:4197),10)';% 测试集――10个样本IN_test = data((4198:end),2:9)';OUT_test = data((4198:end),10)';N = size(IN_test,2);[in_train, ps_input] = ma_梯度阈值等于1说明什么

嵌入式 CC2543 RF中断详解_网程里254c3f-程序员宅基地

文章浏览阅读1.3k次。芯片是TI CC2543 因为公司要求,选定的芯片是TI 的CC2543,这款芯片很少人用,资料也就是官方的资料和例程,下面是我自己根据这几天看的例程,总结一下,如果哪里不对,欢迎大家斧正。下面用的是TI给的例程,GenericBroadcast 程序。_网程里254c3f

iOS视图控制器<1>_ios 视差视图控制器。-程序员宅基地

文章浏览阅读425次。在iOS中,动态界面是通过视图控制器来管理的,视图控制器是UIViewController的实例。一个视图控制器管理一个单独的视图,当然,这个视图还有子视图。视图控制器的view属性指向它管理的视图,即视图控制器的主视图(main view)。视图控制器的主视图并不拥有一个直接指向管理它的视图控制器的指针,但是视图控制器是UIResponder,在响应者链中刚好处在它的视图之上,所以视图控制器就是视_ios 视差视图控制器。

计算机毕业设计Node.js+Vue家政预约系统(程序+源码+LW+部署)_基于vue和node.js的家用电器维修预约管理系统的设计与实现-程序员宅基地

文章浏览阅读150次。该项目含有源码、文档、程序、数据库、配套开发软件、软件安装教程。欢迎交流项目运行环境配置:项目技术:Express框架 + Node.js+ Vue 等等组成,B/S模式 +Vscode管理+前后端分离等等。环境需要1.运行环境:最好是Nodejs最新版,我们在这个版本上开发的。其他版本理论上也可以。2.开发环境:Vscode或HbuilderX都可以。推荐HbuilderX;3.mysql环境:建议是用5.7版本均可4.硬件环境:windows 7/8/10 1G内存以上;_基于vue和node.js的家用电器维修预约管理系统的设计与实现

Android 10系统及以上IMEI的获取_android10获取设备mmei-程序员宅基地

文章浏览阅读2.1k次。IMEI是一个15位的数字标识,用于唯一标识移动通信设备,例如手机、平板电脑和调制解调器等。您可以通过拨打"*#06#"(或类似的代码)来查看您的设备的IMEI号码。且每个应用的Android ID都不一样,该Android ID除非进行恢复出产设置或者刷机,否则是一直不会改变,这是Google处于隐私考虑,提供给应用开发者一个临时长期的唯一识别码(广告ID)在Android10系统,正常情况下是不允许直接获取到IMEI,而是由系统生成一串虚拟的Android ID。_android10获取设备mmei