在一台虚拟机上做kafka集群,使用Java代码发,接消息,kafka tool的使用_向kafka集群发送消息,可以在任意台服务上看到吗-程序员宅基地

技术标签: kafka tool 一台虚拟机 Java代码发 cenos7 kafka集群 接消

1.Kafka

kafka是一个开源的分布式消息系统,由linkedin使用scala编写,用作LinkedIn的活动流(Activity Stream)和运营数据处理管道(Pipeline)的基础。具有高水平扩展和高吞吐量。

1.1 kafka的设计目标

1.高吞吐量。

2.数据磁盘持久化:消息不在内存中cache,直接写入到磁盘,充分利用磁盘的顺序读写性能。

3.zero-copy:减少IO操作步骤。

4.支持数据批量发送和拉取。

5.支持数据压缩。

6.Topic划分为多个partition,提高并行处理能力。

1.2 相关概念

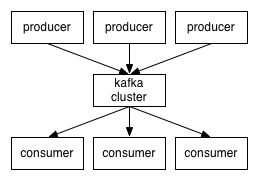

1.Producer :消息生产者,就是向kafka broker发消息的客户端。

2.Consumer :消息消费者,向kafka broker取消息的客户端

3.Topic :主题,存放信息的地方,可以理解为一个队列。

4.Consumer Group (CG):消费组.这是kafka用来实现一个topic消息的广播(发给所有的consumer)和单播(发给任意一个consumer)的手段。一个topic可以有多个CG。topic的消息会复制(不是真的复制,是概念上的)到所有的CG,但每个CG只会把消息发给该CG中的一个consumer。如果需要实现广播,只要每个consumer有一个独立的CG就可以了。要实现单播只要所有的consumer在同一个CG。用CG还可以将consumer进行自由的分组而不需要多次发送消息到不同的topic。

5.Broker :一台kafka服务器就是一个broker。一个集群由多个broker组成。一个broker可以容纳多个topic。

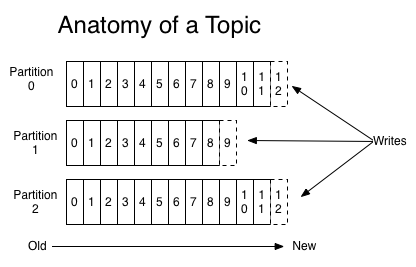

6.Partition:分区. 一个Topic中的消息数据按照多个分区组织,分区是kafka消息队列组织的最小单位,一个分区可以看作是一个FIFO( First Input First Output的缩写,先入先出队列)的队列。为了实现扩展性,一个非常大的topic可以分布到多个broker(即服务器)上,一个topic可以分为多个partition,每个partition是一个有序的队列。partition中的每条消息都会被分配一个有序的id(offset)。kafka只保证按一个partition中的顺序将消息发给consumer,不保证一个topic的整体(多个partition间)的顺序。

7.Offset:消息偏移量.kafka的存储文件都是按照offset.kafka来命名,用offset做名字的好处是方便查找。例如你想找位于2049的位置,只要找到2048.kafka的文件即可。当然the first offset就是00000000000.kafka

1.3 kafka架构

1.4 Topic与分区架构

1.5 kafka集群(一台虚拟机上)

前提:

kafka集群依赖zookeeper集群,所以必须要先有zookeeper集群.可参看我的上一篇文章:<<在一台虚拟机上做zookeeper集群>>

软件环境: cenos7虚拟机一台, kafka_2.12-2.1.0.tar.gz

Kafka下载地址: http://kafka.apache.org/downloads

步骤:

创建kafka文件夹,上传安装包

cd /usr/dev-soft && mkdir kafka && cd kafka

rz,选择安装包上传

解压

tar –zxvf kafka_2.12-2.1.0.tar.gz

创建3个保存消息的文件夹

mkdir kafka-logs-1 kafka-logs-2 kafka-logs-3

修改配置文件server.properties

vi kafka_2.12-2.1.0/config/server.properties

命令模式下输入 :set nu显示行号

修改:

第21行: broker.id=1

第31行: listeners=PLAINTEXT://192.168.81.128:9091

第36行: advertised.listeners=PLAINTEXT://192.168.81.128:9091

第60行: log.dirs=/usr/dev-soft/kafka/kafka-logs-1

第123行: zookeeper.connect=192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183

至此一个kafka应用配置完成.本次集群使用3个kafka应用,复制2份,修改即可.

步骤:

修改名字,复制2份

mv kafka_2.12-2.1.0 kafka_2.12-2.1.0-1

cp –r kafka_2.12-2.1.0-1 kafka_2.12-2.1.0-2

cp –r kafka_2.12-2.1.0-1 kafka_2.12-2.1.0-3

第二台修改server.properties

vi kafka_2.12-2.1.0-2/config/server.properties

修改:

第21行: broker.id=2

第31行: listeners=PLAINTEXT://192.168.81.128:9092

第36行: advertised.listeners=PLAINTEXT://192.168.81.128:9092

第60行: log.dirs=/usr/dev-soft/kafka/kafka-logs-2

第三台修改server.properties

vi kafka_2.12-2.1.0-3/config/server.properties

修改:

第21行: broker.id=3

第31行: listeners=PLAINTEXT://192.168.81.128:9093

第36行: advertised.listeners=PLAINTEXT://192.168.81.128:9093

第60行: log.dirs=/usr/dev-soft/kafka/kafka-logs-3

Kafka集群配置完成.

2.5.1启动&关闭集群

编写启动脚本(其实就是依次启动3个kafka)

cd /usr/dev-soft/kafka

vim kafka-start.sh

内容如下:

cd kafka_2.12-2.1.0-1

bin/kafka-server-start.sh -daemon config/server.properties

cd ../kafka_2.12-2.1.0-2

bin/kafka-server-start.sh -daemon config/server.properties

cd ../kafka_2.12-2.1.0-3

bin/kafka-server-start.sh -daemon config/server.properties

cd ../

同理关闭脚本如下:

vim kafka-stop.sh

写入以下内容:

kafka_2.12-2.1.0-1/bin/kafka-server-stop.sh

kafka_2.12-2.1.0-2/bin/kafka-server-stop.sh

kafka_2.12-2.1.0-3/bin/kafka-server-stop.sh

依次赋予执行权限

chmod u+x kafka-start.sh

chmod u+x kafka-stop.sh

启动kafka集群:(注意要先启动zookeeper集群)

./ kafka-start.sh

启动会有点慢,稍等后,输入jps命令查看结果:

这样说明启动成功了,但是需要发送信息证明集群的可用行,在此之前,需要先把9091,9092,9093这三个端口对外开放,消息的发送和拉取就是通过这些端口的.

执行如下命令:

开放端口:

firewall-cmd --zone=public --add-port=9091/tcp –permanent

firewall-cmd --zone=public --add-port=9092/tcp –permanent

firewall-cmd --zone=public --add-port=9093/tcp --permanent

重启防火墙:

firewall-cmd --reload

查看端口号是否开启:

firewall-cmd --query-port=9091/tcp

firewall-cmd --query-port=9092/tcp

firewall-cmd --query-port=9093/tcp

2.5.2 发送消息&消费消息

在一个kafka应用上操作即可

cd /usr/dev-soft/kafka/ kafka_2.12-2.1.0-1

创建topic:kafkatest

bin/kafka-topics.sh --create --zookeeper 192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183 --replication-factor 2 --partitions 2 --topic kafkatest

查看topic:

某个topic

bin/kafka-topics.sh --describe --zookeeper 192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183 --topic kafkatest

全部topic

bin/kafka-topics.sh --list --zookeeper 192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183

发送信息:

bin/kafka-console-producer.sh --broker-list 192.168.81.128:9091,192.168.81.128:9092,192.168.81.128:9093 --topic kafkatest

消费信息:

打开另一个窗口:

cd /usr/dev-soft/kafka/ kafka_2.12-2.1.0-1

bin/kafka-console-consumer.sh --bootstrap-server 192.168.81.128:9091,192.168.81.128:9092,192.168.81.128:9093 --from-beginning --topic kafkatest

3.使用Java代码发送,接收消息

使用Springboot项目开发,Springboot已经集成了kafka,开发起来非常简单.

3.1 pom.xml

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<parent>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-parent</artifactId>

<version>2.1.1.RELEASE</version>

<relativePath/> <!-- lookup parent from repository -->

</parent>

<groupId>com.mlsama</groupId>

<artifactId>kafka</artifactId>

<version>1.0.0</version>

<name>kafka</name>

<description>Demo project for Spring Boot</description>

<properties>

<java.version>1.8</java.version>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka-test</artifactId>

<scope>test</scope>

</dependency>

<!--lombok约束-->

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

</dependency>

<!--日记-->

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>log4j-over-slf4j</artifactId>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

</build>

</project>

3.2 application.properties

#修改端口

server.port=8899

#springMVC的配置

#视图前缀

spring.mvc.view.prefix=/html/

#视图后缀

spring.mvc.view.suffix=.html

#kafka相关配置

spring.kafka.bootstrap-servers=192.168.81.128:9091,192.168.81.128:9092,192.168.81.128:9093

#设置一个默认组

spring.kafka.consumer.group-id=0

#key-value序列化反序列化

spring.kafka.consumer.key-deserializer=org.apache.kafka.common.serialization.StringDeserializer

spring.kafka.consumer.value-deserializer=org.apache.kafka.common.serialization.StringDeserializer

spring.kafka.producer.key-serializer=org.apache.kafka.common.serialization.StringSerializer

spring.kafka.producer.value-serializer=org.apache.kafka.common.serialization.StringSerializer

#每次批量发送消息的数量

spring.kafka.producer.batch-size=12800

spring.kafka.producer.buffer-memory=1024003.3 KafkaProduct.Class

@RestController

@Slf4j

public class KafkaProduct {

@Autowired

private KafkaTemplate<String, String> kafkaTemplate;

@GetMapping("/index")

public String kafka(){

return "kafka";

}

/**

* 发送消息到kafka对应的topic

* @param topic

* @param message

*/

@RequestMapping("/kafka/sendMessage")

public String sendMessage(@RequestParam("topic")String topic, @RequestParam("message")String message) {

try {

ListenableFuture<SendResult<String, String>> send = kafkaTemplate.send(topic, 0,System.currentTimeMillis(),"test",message);

send.addCallback(new SuccessCallback() {

@Override

public void onSuccess(@Nullable Object obj) {

SendResult<String, String> sendResult = (SendResult) obj;

//...

log.info("消息发送成功:{}", sendResult);

}

}, new FailureCallback() {

@Override

public void onFailure(Throwable throwable) {

log.info("消息发送失败,case:{}", throwable);

//失败处理

}

});

return "消息发送成功";

}catch (Exception e){

return "消息发送失败";

}

}3.4 KafkaConsumer.Class

/**

* 消费信息,监听一系列topic的信息

* @param record

*/

@KafkaListener(topics = {"test","kafkatest"})

private void consumerMessage(ConsumerRecord<?, ?> record) {

Optional<?> kafkaMessage = Optional.ofNullable(record.value());

if (kafkaMessage.isPresent()) {

Object message = kafkaMessage.get();

log.info("----------------- 返回的信息对象:{}",record);

log.info("------------------收到的message:{}",message);

}

}3.5 kafka.html

<!DOCTYPE html>

<html lang="en">

<head>

<meta charset="UTF-8">

<title>kafka页面</title>

</head>

<body>

<form action="http://127.0.0.1:8899/kafka/sendMessage" method="post">

主题:<input type="text" name="topic"/><br>

信息:<input type="text" name="message"/><br>

<input type="submit" value="发送"/>

</form>

</body>

</html>3.6 启动类KafkaApplication

package com.mlsama.kafka;

import org.springframework.boot.Banner;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

@SpringBootApplication

public class KafkaApplication {

public static void main(String[] args) {

/** 创建SpringApplication应用对象 */

SpringApplication springApplication =

new SpringApplication(KafkaApplication.class);

/** 设置横幅模式(设置关闭) */

springApplication.setBannerMode(Banner.Mode.OFF);

/** 运行 */

springApplication.run(args);

}

}直接运行启动类,访问: http://127.0.0.1:8899/index

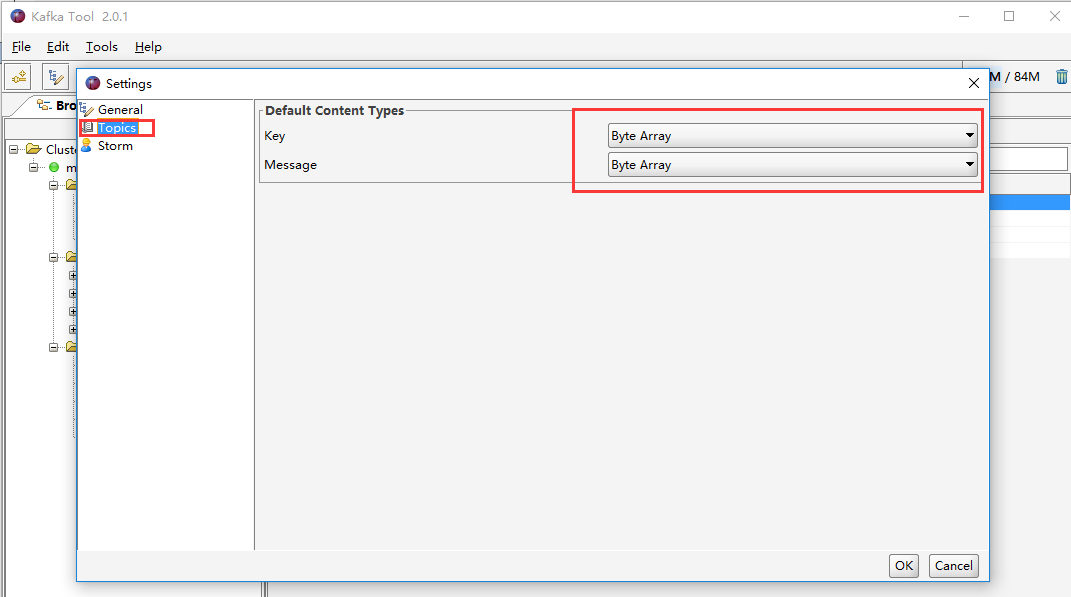

4 kafka tool

Kafka tool提供一个界面,可以直观的看到kafka集群的信息,包括topic,partition,发送的消息等.

下载地址:http://www.kafkatool.com/download.html 现在只有2个版本,因为安装的kafka版本是2.1.0,所以下载Windows版的2.0.3.安装是傻瓜式的的.第一次打开kafka tool会提示设置连接kafka 集群.点击确认后,界面如下:

设置完,点击test,提示连接成功后,点击add

设置消息以String显示:

Tool---setting,点击topics,把右边的key和message设置为String即可.

查看kafka的数据:

智能推荐

js-选项卡原理_选项卡js原理-程序员宅基地

文章浏览阅读90次。【代码】js-选项卡原理。_选项卡js原理

设计模式-原型模式(Prototype)-程序员宅基地

文章浏览阅读67次。原型模式是一种对象创建型模式,它采用复制原型对象的方法来创建对象的实例。它创建的实例,具有与原型一样的数据结构和值分为深度克隆和浅度克隆。浅度克隆:克隆对象的值类型(基本数据类型),克隆引用类型的地址;深度克隆:克隆对象的值类型,引用类型的对象也复制一份副本。UML图:具体代码:浅度复制:import java.util.List;/*..._prototype 设计模式

个性化政府云的探索-程序员宅基地

文章浏览阅读59次。入选国内首批云计算服务创新发展试点城市的北京、上海、深圳、杭州和无锡起到了很好的示范作用,不仅促进了当地产业的升级换代,而且为国内其他城市发展云计算产业提供了很好的借鉴。据了解,目前国内至少有20个城市确定将云计算作为重点发展的产业。这势必会形成新一轮的云计算基础设施建设的**。由于云计算基础设施建设具有投资规模大,运维成本高,投资回收周期长,地域辐射性强等诸多特点,各地在建...

STM32问题集之BOOT0和BOOT1的作用_stm32boot0和boot1作用-程序员宅基地

文章浏览阅读9.4k次,点赞2次,收藏20次。一、功能及目的 在每个STM32的芯片上都有两个管脚BOOT0和BOOT1,这两个管脚在芯片复位时的电平状态决定了芯片复位后从哪个区域开始执行程序。BOOT1=x BOOT0=0 // 从用户闪存启动,这是正常的工作模式。BOOT1=0 BOOT0=1 // 从系统存储器启动,这种模式启动的程序_stm32boot0和boot1作用

C语言函数递归调用-程序员宅基地

文章浏览阅读3.4k次,点赞2次,收藏22次。C语言函数递归调用_c语言函数递归调用

明日方舟抽卡模拟器wiki_明日方舟bilibili服-明日方舟bilibili服下载-程序员宅基地

文章浏览阅读410次。明日方舟bilibili服是一款天灾驾到战斗热血的创新二次元废土风塔防手游,精妙的二次元纸片人设计,为宅友们源源不断更新超多的纸片人老婆老公们,玩家将扮演废土正义一方“罗德岛”中的指挥官,与你身边的感染者们并肩作战。与同类塔防手游与众不同的几点,首先你可以在这抽卡轻松获得稀有,同时也可以在战斗体系和敌军走位机制看到不同。明日方舟bilibili服设定:1、起因不明并四处肆虐的天灾,席卷过的土地上出..._明日方舟抽卡模拟器

随便推点

Maven上传Jar到私服报错:ReasonPhrase: Repository version policy: SNAPSHOT does not allow version: xxx_repository version policy snapshot does not all-程序员宅基地

文章浏览阅读437次。Maven上传Jar到私服报错:ReasonPhrase: Repository version policy: SNAPSHOT does not allow version: xxx_repository version policy snapshot does not all

斐波那契数列、素数、质数和猴子吃桃问题_斐波那契日-程序员宅基地

文章浏览阅读1.2k次。斐波那契数列(Fibonacci Sequence)是由如下形式的一系列数字组成的:0, 1, 1, 2, 3, 5, 8, 13, 21, 34, …上述数字序列中反映出来的规律,就是下一个数字是该数字前面两个紧邻数字的和,具体如下所示:示例:比如上述斐波那契数列中的最后两个数,可以推导出34后面的数为21+34=55下面是一个更长一些的斐波那契数列:0, 1, 1, 2, 3, 5, 8, 13, 21, 34, 55, 89, 144, 233, 377, 610, 987, 1597, 2584,_斐波那契日

PHP必会面试题_//该层循环用来控制每轮 冒出一个数 需要比较的次数-程序员宅基地

文章浏览阅读363次。PHP必会面试题1. 基础篇1. 用 PHP 打印出前一天的时间格式是 2017-12-28 22:21:21? //>>1.当前时间减去一天的时间,然后再格式化echo date('Y-m-d H:i:s',time()-3600*24);//>>2.使用strtotime,可以将任何字符串时间转换成时间戳,仅针对英文echo date('Y-m-d H:i:s',str..._//该层循环用来控制每轮 冒出一个数 需要比较的次数

windows用mingw(g++)编译opencv,opencv_contrib,并install安装_opencv mingw contrib-程序员宅基地

文章浏览阅读1.3k次,点赞26次,收藏26次。windows下用mingw编译opencv貌似不支持cuda,选cuda会报错,我无法解决,所以没选cuda,下面两种编译方式支持。打开cmake gui程序,在下面两个框中分别输入opencv的源文件和编译目录,build-mingw为你创建的目录,可自定义命名。1、如果已经安装Qt,则Qt自带mingw编译器,从Qt安装目录找到编译器所在目录即可。1、如果已经安装Qt,则Qt自带cmake,从Qt安装目录找到cmake所在目录即可。2、若未安装Qt,则安装Mingw即可,参考我的另外一篇文章。_opencv mingw contrib

5个高质量简历模板网站,免费、免费、免费_hoso模板官网-程序员宅基地

文章浏览阅读10w+次,点赞42次,收藏309次。今天给大家推荐5个好用且免费的简历模板网站,简洁美观,非常值得收藏!1、菜鸟图库https://www.sucai999.com/search/word/0_242_0.html?v=NTYxMjky网站主要以设计类素材为主,办公类素材也很多,简历模板大部个偏简约风,各种版式都有,而且经常会更新。最重要的是全部都能免费下载。2、个人简历网https://www.gerenjianli.com/moban/这是一个专门提供简历模板的网站,里面有超多模板个类,找起来非常方便,风格也很多样,无须注册就能免费下载,_hoso模板官网

通过 TikTok 联盟提高销售额的 6 个步骤_tiktok联盟-程序员宅基地

文章浏览阅读142次。你听说过吗?该计划可让您以推广您的产品并在成功销售时支付佣金。它提供了新的营销渠道,使您的产品呈现在更广泛的受众面前并提高品牌知名度。此外,TikTok Shop联盟可以是一种经济高效的产品或服务营销方式。您只需在有人购买时付费,因此不存在在无效广告上浪费金钱的风险。这些诱人的好处是否足以让您想要开始您的TikTok Shop联盟活动?如果是这样,本指南适合您。_tiktok联盟