【实验记录】U-Net训练自己的数据集(Keras)_自定义数据集训练u-net-程序员宅基地

技术标签: # U-Net tensorflow 深度学习 keras

论文地址:https://arxiv.org/abs/1505.04597

代码地址:https://github.com/zhixuhao/unet

环境配置

CUDA 8.0

cuDNN

Tensorflow 1.2.1

Keras 2.0.6

Python 3.5

# 创建虚拟环境

conda create -n u-net python=3.5

conda activate u-net

# 安装依赖

pip install tensorflow-gpu==1.2.1

pip install keras==2.0.6

pip install scikit-image

conda install numpy

conda install h5py

代码说明

可以运行一下代码中自带的数据集 membrane 看看:

python main.py

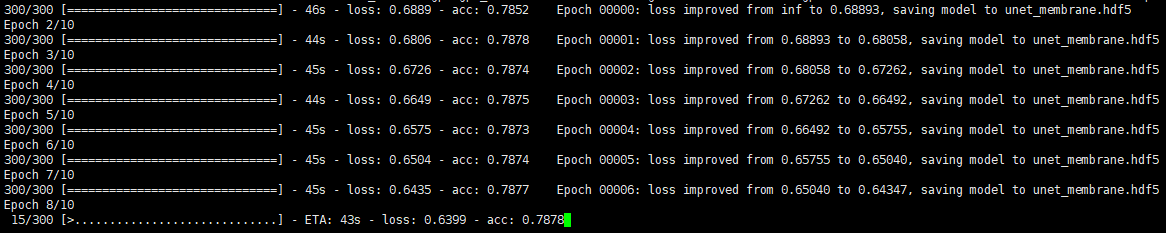

正常训练的话是这个样子:

main.py 是执行训练的主文件,其中:

data_gen_args定义了数据扩充操作trainGenerator前四个参数分别为 1)训练的 batch_size,2)训练文件的主路径,3)训练图像的文件夹名称,4)训练图像对应标签的文件夹名称,接下来分别是 5)数据扩充操作,6、7)图像、标签的色彩模式,8、9)图像、标签的保存路径,10)是否多类别,11)类别个数(num_class 大于 2 的就属于多类别,flag 就应该设置为 True),12)是否保存,13)图片大小

训练 & 测试

1. 准备数据文件

在 ~/unet-master/data 下创建自己的数据集文件夹,比如 mydata。在 mydata 下创建 train 和 test 文件夹用于存放训练和测试数据。其中 train/image 和 train/label 中分别存放训练图像和对应的标签。test 下直接放所有测试图像即可。

2. 修改主文件 main.py

(1)修改训练文件路径及 batch size

myGene = trainGenerator(10,'data/mydata/train','image','label',data_gen_args,save_to_dir = None)

- 参数分别为 batch size(这里设为了 10),训练图像根目录,训练图像文件夹,训练图像对应标签文件夹

(2)修改 checkpoint 保存名称

model_checkpoint = ModelCheckpoint('unet_mydata.hdf5', monitor='loss',verbose=1, save_best_only=True)

(3)修改训练 epoch

model.fit_generator(myGene,steps_per_epoch=80,epochs=100,callbacks=[model_checkpoint],class_weight={

1,245,245,245})

steps_per_epoch是每个 epoch 要迭代多少次,比如训练图像有 800 张,设训练 batch 为 10 的话,steps 就是 800 / 10 = 80;epochs为训练的 epoch 数,这里设为了 100;

(4)修改测试路径

testGene = testGenerator("data/mydata/test")

# 测试图片有 400 张

results = model.predict_generator(testGene,400,verbose=1)

saveResult("data/mydata/test",results)

3. 执行训练 & 测试

python main.py

另外,使用自己定义的 loss 函数,就在 model.py 修改使用的 loss 函数

model.compile(optimizer = Adam(lr = 1e-4), loss = 'ACLoss', metrics = ['accuracy'])

然后相应地,通过上面的 compile 找到了损失函数定义的 losses.py 文件,把自己的 loss 函数加进去就可以啦,输入参数为 (y_pred, y_true)

4. 多类别训练

源代码训练单类别,也就是只有前景(1)和背景(0)时没有问题,但是在进行多类别分割时报错:

ValueError: Error when checking target: expected conv2d_24 to have 4 dimensions, but got array with shape (5, 65536, 4)

原因:查了下原因是这个代码不适用于多类分割任务,参考了这篇文章,对代码做出修改。

解决:

(1)修改数据处理文件 data.py

def adjustData(img,mask,flag_multi_class,num_class):

if(flag_multi_class):

img = img / 255

mask = mask[:,:,:,0] if(len(mask.shape) == 4) else mask[:,:,0]

new_mask = np.zeros(mask.shape + (num_class,))

for i in range(num_class):

#for one pixel in the image, find the class in mask and convert it into one-hot vector

#index = np.where(mask == i)

#index_mask = (index[0],index[1],index[2],np.zeros(len(index[0]),dtype = np.int64) + i) if (len(mask.shape) == 4) else (index[0],index[1],np.zeros(len(index[0]),dtype = np.int64) + i)

#new_mask[index_mask] = 1

new_mask[mask == i,i] = 1

# 对这里进行了修改

new_mask = np.reshape(new_mask,(new_mask.shape[0],new_mask.shape[1],new_mask.shape[2],new_mask.shape[3])) if flag_multi_class else np.reshape(new_mask,(new_mask.shape[0]*new_mask.shape[1],new_mask.shape[2]))

mask = new_mask

elif(np.max(img) > 1):

img = img / 255

mask = mask /255

mask[mask > 0.5] = 1

mask[mask <= 0.5] = 0

return (img,mask)

(2)修改模型文件 model.py 第大约第 53 行,因为报错中的 conv2d_24 实际就是 conv10,这里第一个参数 1 就是我们的类别数,将其修改为自己的类别数量即可。

# 将源代码:

conv10 = Conv2D(1, 1, activation = 'sigmoid')(conv9)

# 修改为:

conv10 = Conv2D(4, 1, activation = 'sigmoid')(conv9)

(3)修改损失函数:源代码使用的是二元交叉熵,不适用于多类别分割问题,故这里改为 Dice loss。

# data.py line 39

new_mask = np.reshape(new_mask,(new_mask.shape[0],new_mask.shape[1],new_mask.shape[2],new_mask.shape[3])) if flag_multi_class else np.reshape(new_mask,(new_mask.shape[0]*new_mask.shape[1],new_mask.shape[2]))

# model.py line 53

conv10 = Conv2D(4, 1, activation = 'sigmoid')(conv9)

报错记录与解决

【1】 ImportError: cannot import name 'tf_utils'

原因:keras 和 tensorflow 版本不兼容。

解决:tensorflow 1.2.1 和 keras 2.0.6 是 OK 的。

pip install tensorflow-gpu==1.2.1

pip install keras==2.0.6

=========================================================

【2】ImportError: `save_model` requires h5py

解决:安装 h5py:conda install h5py

=========================================================

【3】 tensorflow.python.framework.errors_impl.InternalError: Blas GEMM launch failed

原因:GPU 被占用

解决:确保一下 GPU 足够用呀~

=========================================================

【4】

Traceback (most recent call last):

File "main.py", line 21, in <module>

results = model.predict_generator(testGene,30,verbose=1)

File "/data/zyy/usr/local/anaconda3/envs/u-net/lib/python3.5/site-packages/keras/legacy/interfaces.py", line 87, in wrapper

return func(*args, **kwargs)

File "/data/zyy/usr/local/anaconda3/envs/u-net/lib/python3.5/site-packages/keras/engine/training.py", line 2067, in predict_generator

generator_output = next(output_generator)

StopIteration

Traceback (most recent call last):

File "/data/zyy/usr/local/anaconda3/envs/u-net/lib/python3.5/threading.py", line 914, in _bootstrap_inner

self.run()

File "/data/zyy/usr/local/anaconda3/envs/u-net/lib/python3.5/threading.py", line 862, in run

self._target(*self._args, **self._kwargs)

File "/data/zyy/usr/local/anaconda3/envs/u-net/lib/python3.5/site-packages/keras/utils/data_utils.py", line 560, in data_generator_task

generator_output = next(self._generator)

StopIteration

原因不知道,参考以下回答:

[1] https://github.com/zhixuhao/unet/issues/130

[2] https://stackoverflow.com/questions/46302911/what-raises-stopiteration-in-mine-keras-model-fit-generator

解决:

(1)根据 2067 行的报错,找到 training.py 代码中第 2003 行,将 max_queue_size 设置为 1

def predict_generator(self, generator, steps,

max_queue_size=1, # modified

workers=1,

use_multiprocessing=False,

verbose=0):

=========================================================

【5】 Lossy conversion from float32 to uint8. Range [0, 1]. Convert image to uint8 prior to saving to suppress this warning.

原因:关于精度的警告,就是说从 float32 直接保存为 uint8 类型可能会损失精度。参考:https://www.jianshu.com/p/84b825b9e8a3

解决:将 image 转换为 uint8 类型。修改 data.py 最后的保存函数:

from skimage import img_as_ubyte

def saveResult(save_path,npyfile,flag_multi_class = False,num_class = 2):

for i,item in enumerate(npyfile):

img = labelVisualize(num_class,COLOR_DICT,item) if flag_multi_class else item[:,:,0]

io.imsave(os.path.join(save_path,"%d_predict.png"%i),img_as_ubyte(img)) # modified

不过仍然会报一个警告,总比每张图片都有警告好

UserWarning: Possible precision loss when converting from float32 to uint8 .format(dtypeobj_in, dtypeobj_out))

=========================================================

智能推荐

解决electron+vue项目起始加载慢的问题_electron vue项目打开慢-程序员宅基地

文章浏览阅读461次。_electron vue项目打开慢

linux下编译GDAL外加扩展格式支持(五)--完-程序员宅基地

文章浏览阅读229次。接1、2、3、4篇。10、安装mysql支持安装fedora15或者16系统时若选择安装mysql数据库,则必须自行安装mysql开发包。因为自带默认数据库不会安装这个包。否则会遇到mysql错误:ogr_mysql.h:34:23: fatal error: my_global.h: No such file or directory#问题原因:找不到mysql头文件..._linux gdal netcdf5

Linux tc qdisc 模拟网络丢包延时-程序员宅基地

文章浏览阅读1.2k次。Linux tc qdisc 模拟网络丢包延时_tc qdisc

linux64bit 安装 jdk 1.7-程序员宅基地

文章浏览阅读336次。linux64bit 安装 jdk 1.7下载地址 : https://edelivery.oracle.com/otn-pub/java/jdk/7u21-b11/jdk-7u21-linux-x64.rpm0. 卸载rpm版的jdk: #rpm -qa|grep jdk 显示:jdk-1.6.0_10-fcs 卸载:#rpm -e --nodep..._liunx64位得jdk1.7

【Linux笔记】-----Nginx/LVS/HAProxy负载均衡的优缺点_中间件应用场景nginx lvs proxy-程序员宅基地

文章浏览阅读552次。开始听到负载均衡的时候,我第一反应想到的是链路负载均衡,在此之前主要是在学习网络方面知识,像在NA、NP阶段实验做链路负载均衡时常会遇到,后来还接触到SLB负载分担技术,这都是在链路基础上实现的。 其实负载均衡可以分为硬件实现负载均衡和软件实现负载均衡。 硬件实现负载均衡:常见F5和Array负载均衡器,配套专业维护服务,但是成本昂贵。 软件实现负载均衡:常见开源免费的负载均衡软件有Ngin..._中间件应用场景nginx lvs proxy

多维时序 | MATLAB实现CNN-LSTM多变量时序预测_cnn可以进行多步预测-程序员宅基地

文章浏览阅读4.7k次。多维时序 | MATLAB实现CNN-LSTM多变量时序预测目录多维时序 | MATLAB实现CNN-LSTM多变量多步预测基本介绍模型特点程序设计学习总结参考资料基本介绍本次运行测试环境MATLAB2020b,MATLAB实现CNN-LSTM多变量多步预测。模型特点深度学习使用分布式的分层特征表示方法自动提取数据中的从最低层到最高层固有的抽象特征和隐藏不变结构. 为了充分利用单个模型的优点并提高预测性能, 现已提出了许多组合模型。CNN 是多层前馈神经网络, 已被证明在提取隐藏_cnn可以进行多步预测

随便推点

【9.3】用户和组的管理、密码_polkitd:input 用户和组-程序员宅基地

文章浏览阅读219次。3.1 用户配置文件和密码配置文件3.2 用户组管理3.3 用户管理3.4 usermod命令3.5 用户密码管理3.6 mkpasswd命令_polkitd:input 用户和组

pca算法python代码_三种方法实现PCA算法(Python)-程序员宅基地

文章浏览阅读670次。主成分分析,即Principal Component Analysis(PCA),是多元统计中的重要内容,也广泛应用于机器学习和其它领域。它的主要作用是对高维数据进行降维。PCA把原先的n个特征用数目更少的k个特征取代,新特征是旧特征的线性组合,这些线性组合最大化样本方差,尽量使新的k个特征互不相关。关于PCA的更多介绍,请参考:https://en.wikipedia.org/wiki/Prin..._inprementation python code of pca

内存地址Linux下内存分配与映射之一-程序员宅基地

文章浏览阅读35次。发一下牢骚和主题无关:地址类型:32位的cpu,共4G间空,其中0-3G属于用户间空地址,3G-4G是内核间空地址。用户虚拟地址:用户间空程序的地址物理地址:cpu与内存之间的用使地址总线地址:外围总线和内存之间的用使地址内核逻辑地址:内存的分部或全体射映,大多数情况下,它与物理地址仅差一个偏移量。如Kmalloc分..._linux 内存条与内存地址

自动化测试介绍_自动化测试中baw库指的什么-程序员宅基地

文章浏览阅读1.3k次,点赞2次,收藏16次。什么是自动化测试? 做测试好几年了,真正学习和实践自动化测试一年,自我感觉这一个年中收获许多。一直想动笔写一篇文章分享自动化测试实践中的一些经验。终于决定花点时间来做这件事儿。 首先理清自动化测试的概念,广义上来讲,自动化包括一切通过工具(程序)的方式来代替或辅助手工测试的行为都可以看做自动化,包括性能测试工具(loadrunner、jmeter),或自己所写的一段程序,用于_自动化测试中baw库指的什么

a0图框标题栏尺寸_a0图纸尺寸(a0图纸标题栏尺寸标准国标)-程序员宅基地

文章浏览阅读1.6w次。A0纸指的是一平方米大小的白银比例长方形纸(长为1189mm宽为841mm)。A0=1189mm*841mm A1=841mm*594mm 相当于1/2张A0纸 A2=594mm*420mm 相当于1/4.A1图纸大小尺寸:841mm*594mm 即长为841mm,宽为594mm 过去是以多少"开"(例如8开或16开等)来表示纸张的大小,我国采用国际标准,规定以 A0、A1、A2、.GB/T 14..._a0图纸尺寸

TreeTable的简单实现_treetable canvas-程序员宅基地

文章浏览阅读966次。最终效果图:UI说明:针对table本身进行增强的tree table组件。 tree的数据来源是单元格内a元素的自定义属性:level和type。具体代码如下:Java代码 DepartmentEmployeeIDposi_treetable canvas