python爬取图片(正则、bs4、Xpath三种方法)_爬出图片-程序员宅基地

技术标签: ps4 爬虫 python xpath 正则表达式

本文给出爬取三个图片网站的案例,分别用到了正则表达式、bs4、Xpath三种解析方式。

目录:

案例一:正则表达式解析

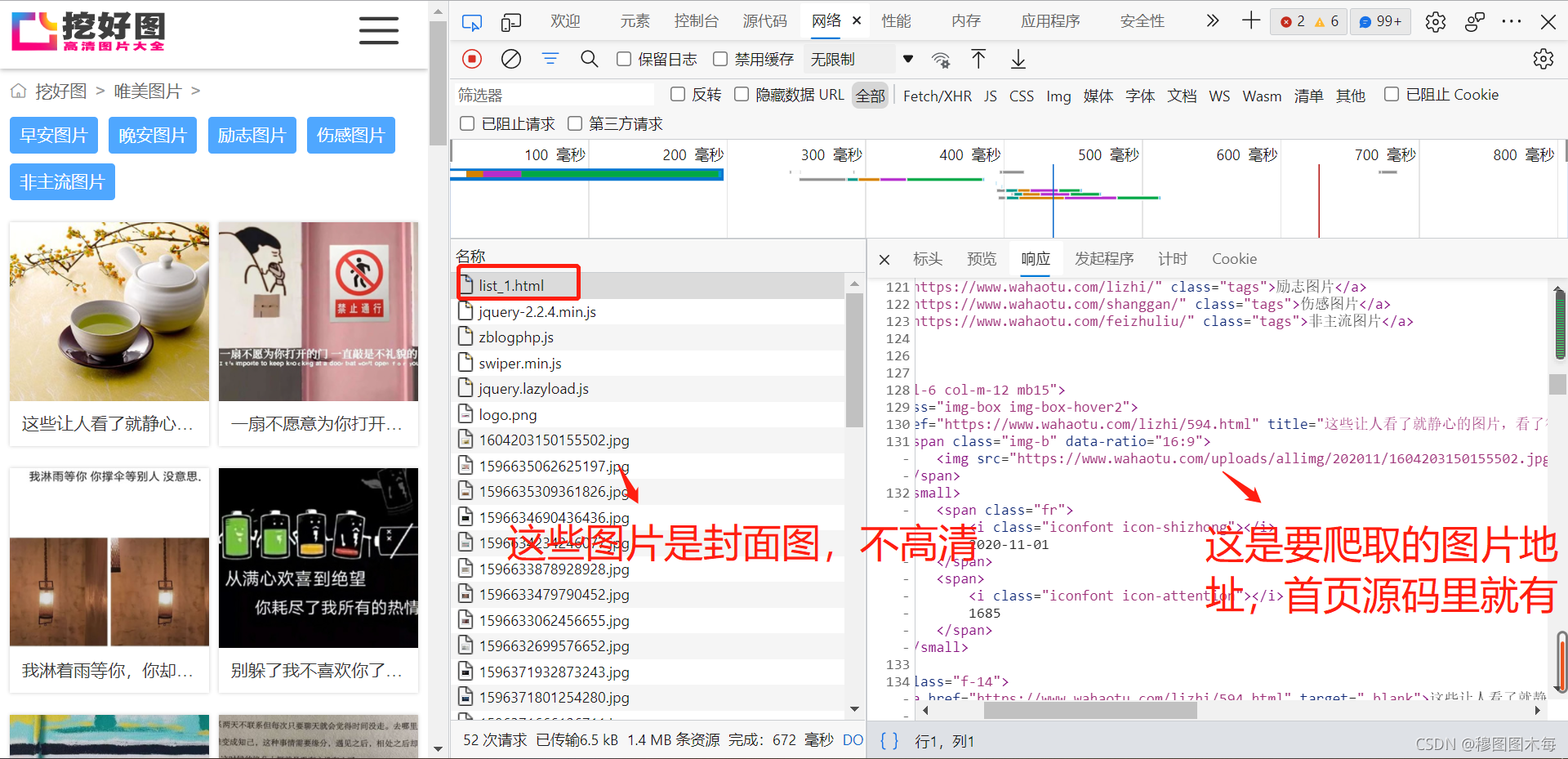

需求:爬取挖好图网”唯美分类“中的图片

详细代码如下:

# coding=gbk

import requests

import re

import os

#需求:爬取挖好图唯美图片

#网址:'https://www.wahaotu.com/weimei/list_1.html'

if __name__ == "__main__":

#创建一个文件夹,保存所有的图片

if not os.path.exists('./WeimeiPic'):

os.mkdir('./WeimeiPic')

headers = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.54 Safari/537.36 Edg/95.0.1020.40'

}

url = 'https://www.wahaotu.com/weimei/list_%d.html'

for pageNum in range(1,3):

#对应页码的url

new_url = format(url%pageNum)

#使用通用爬虫对url对应的一整张页面进行爬取

page_text = requests.get(url=new_url,headers=headers).text

#使用聚焦爬虫将页面所有的图片进行解析、提取

obj = re.compile(r'<span class="img-box img-box-hover2">.*?<span class="img-b" data-ratio="16:9">'

r'<img src="(?P<website>.*?)" alt=".*?" class="lazy"></span>',re.S)

img_src_list = obj.finditer(page_text)

#img_src_list1 = obj.findall(page_text) #返回列表

for it in img_src_list:

url_pic = it.group('website')

img_data = requests.get(url=url_pic,headers=headers).content #返回二进制数据

#生成图片名称,迭代器不知道可以成功,列表肯定可以

img_name = url_pic.split('/')[-1]

imgPath = './WeimeiPic/'+img_name

with open(imgPath,'wb') as fp:

fp.write(img_data)

print(img_name,'下载成功!')运行结束后,图片保存到文件夹中:

案例二: bs4解析

需求:爬取优美图库中分类为“可爱头像”中的图片

主页面其实已经给出图片地址,没必要再进入到子页面。但当时没有注意,代码是按进入子页面抓取图片地址来写的。

这里只爬取了主页面第一页的部分图片,可以参照案例三修改得到所有页码的图片。

# coding=utf-8

"""

1.拿到主页面的源代码,然后提取到子页面的链接地址,href

2.通过href拿到子页面的内容,从子页面中找到图片的下载地址

3,下载图片

"""

import requests

from bs4 import BeautifulSoup

import time

import os

if __name__ == "__main__":

# 创建一个文件夹,保存所有的图片

if not os.path.exists('./TouXiangPic'):

os.mkdir('./TouXiangPic')

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.54 Safari/537.36 Edg/95.0.1020.40'

}

url = "https://www.umei.cc/touxiangtupian/keaitouxiang/"

resp = requests.get(url = url,headers=headers)

resp.encoding ='utf-8' #处理乱码

#把源代码交给BeautifulSoup

main_page = BeautifulSoup(resp.text,"html.parser")

alist = main_page.find("div",class_="TypeList").find_all('a') #把范围第一次缩小

#抓取列表第10到第15张图片

for a in alist[9:15]:

href = a['href']

#href = a.get('href') #通过get拿到属性的值

#拿到主页面的源代码

href_all = "https://www.umei.cc/"+ href

detail_page_resp = requests.get(url=href_all,headers=headers)

detail_page_resp.encoding = 'utf-8'

detail_page_text = detail_page_resp.text

#从子页面中拿到图片的下载途径

detail_page = BeautifulSoup(detail_page_text,'html.parser')

p = detail_page.find("p",align = "center")

img = p.find('img')

src = img['src']

#下载图片

img_resp = requests.get(url=src,headers=headers).content #这里拿到的是字节

img_name = src.split("/")[-1]

#‘wb’:表示以二进制写方式打开,只能写文件,如果文件不存在,创建该文件;如果文件已存在,则覆盖写。

imgPath = './TouXiangPic/' + img_name

with open(imgPath,mode = "wb") as fp:

fp.write(img_resp) #图片内容写入到文件

time.sleep(0.1)

print("=====over!========")运行得到的图片保存到TouXiangPic文件夹中:

案例三: Xpath解析

需求:爬取“我要个性网”中分类为“可爱头像”中的图片

源代码如下:

# -*- coding: utf-8 -*-

import requests

from lxml import etree

import os

if __name__ == "__main__":

#创建一个文件夹,保存所有的图片

if not os.path.exists('./KeaiPic'):

os.mkdir('./KeaiPic')

headers = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.54 Safari/537.36 Edg/95.0.1020.40'

}

urlone = 'https://www.woyaogexing.com/tupian/keai/index.html'

urlother = 'https://www.woyaogexing.com/tupian/keai/index_%d.html'

pic_num = 0 #记录图片名称

for pageNum in range(1,3):

if pageNum == 1:

new_url = urlone

else:

new_url = format(urlother%pageNum)

#使用通用爬虫对url对应的一整张页面进行爬取

page_text = requests.get(url=new_url,headers=headers).text

#使用xpath将页面所有的图片进行解析、提取

tree = etree.HTML(page_text)

img_src_list = tree.xpath("//*[@id='main']/div[3]/div[1]/div[2]/div/a[1]/img/@src")

for it in img_src_list:

url_pic = "https:" + it

img_data = requests.get(url=url_pic,headers=headers).content #返回二进制数据

#生成图片名称,迭代器不知道是否可以成功,列表肯定可以

#img_name = url_pic.split('/')[-1]

#自己定义文件名

img_name = '图片{}{}'.format(str(pic_num),'.jpg')

imgPath = './KeaiPic/'+img_name

with open(imgPath,'wb') as fp:

fp.write(img_data)

pic_num = pic_num+1

print(img_name,'下载成功!')运行后图片保存到文件夹中,并按照下载顺序命名:

智能推荐

c# 调用c++ lib静态库_c#调用lib-程序员宅基地

文章浏览阅读2w次,点赞7次,收藏51次。四个步骤1.创建C++ Win32项目动态库dll 2.在Win32项目动态库中添加 外部依赖项 lib头文件和lib库3.导出C接口4.c#调用c++动态库开始你的表演...①创建一个空白的解决方案,在解决方案中添加 Visual C++ , Win32 项目空白解决方案的创建:添加Visual C++ , Win32 项目这......_c#调用lib

deepin/ubuntu安装苹方字体-程序员宅基地

文章浏览阅读4.6k次。苹方字体是苹果系统上的黑体,挺好看的。注重颜值的网站都会使用,例如知乎:font-family: -apple-system, BlinkMacSystemFont, Helvetica Neue, PingFang SC, Microsoft YaHei, Source Han Sans SC, Noto Sans CJK SC, W..._ubuntu pingfang

html表单常见操作汇总_html表单的处理程序有那些-程序员宅基地

文章浏览阅读159次。表单表单概述表单标签表单域按钮控件demo表单标签表单标签基本语法结构<form action="处理数据程序的url地址“ method=”get|post“ name="表单名称”></form><!--action,当提交表单时,向何处发送表单中的数据,地址可以是相对地址也可以是绝对地址--><!--method将表单中的数据传送给服务器处理,get方式直接显示在url地址中,数据可以被缓存,且长度有限制;而post方式数据隐藏传输,_html表单的处理程序有那些

PHP设置谷歌验证器(Google Authenticator)实现操作二步验证_php otp 验证器-程序员宅基地

文章浏览阅读1.2k次。使用说明:开启Google的登陆二步验证(即Google Authenticator服务)后用户登陆时需要输入额外由手机客户端生成的一次性密码。实现Google Authenticator功能需要服务器端和客户端的支持。服务器端负责密钥的生成、验证一次性密码是否正确。客户端记录密钥后生成一次性密码。下载谷歌验证类库文件放到项目合适位置(我这边放在项目Vender下面)https://github.com/PHPGangsta/GoogleAuthenticatorPHP代码示例://引入谷_php otp 验证器

【Python】matplotlib.plot画图横坐标混乱及间隔处理_matplotlib更改横轴间距-程序员宅基地

文章浏览阅读4.3k次,点赞5次,收藏11次。matplotlib.plot画图横坐标混乱及间隔处理_matplotlib更改横轴间距

docker — 容器存储_docker 保存容器-程序员宅基地

文章浏览阅读2.2k次。①Storage driver 处理各镜像层及容器层的处理细节,实现了多层数据的堆叠,为用户 提供了多层数据合并后的统一视图②所有 Storage driver 都使用可堆叠图像层和写时复制(CoW)策略③docker info 命令可查看当系统上的 storage driver主要用于测试目的,不建议用于生成环境。_docker 保存容器

随便推点

网络拓扑结构_网络拓扑csdn-程序员宅基地

文章浏览阅读834次,点赞27次,收藏13次。网络拓扑结构是指计算机网络中各组件(如计算机、服务器、打印机、路由器、交换机等设备)及其连接线路在物理布局或逻辑构型上的排列形式。这种布局不仅描述了设备间的实际物理连接方式,也决定了数据在网络中流动的路径和方式。不同的网络拓扑结构影响着网络的性能、可靠性、可扩展性及管理维护的难易程度。_网络拓扑csdn

JS重写Date函数,兼容IOS系统_date.prototype 将所有 ios-程序员宅基地

文章浏览阅读1.8k次,点赞5次,收藏8次。IOS系统Date的坑要创建一个指定时间的new Date对象时,通常的做法是:new Date("2020-09-21 11:11:00")这行代码在 PC 端和安卓端都是正常的,而在 iOS 端则会提示 Invalid Date 无效日期。在IOS年月日中间的横岗许换成斜杠,也就是new Date("2020/09/21 11:11:00")通常为了兼容IOS的这个坑,需要做一些额外的特殊处理,笔者在开发的时候经常会忘了兼容IOS系统。所以就想试着重写Date函数,一劳永逸,避免每次ne_date.prototype 将所有 ios

如何将EXCEL表导入plsql数据库中-程序员宅基地

文章浏览阅读5.3k次。方法一:用PLSQL Developer工具。 1 在PLSQL Developer的sql window里输入select * from test for update; 2 按F8执行 3 打开锁, 再按一下加号. 鼠标点到第一列的列头,使全列成选中状态,然后粘贴,最后commit提交即可。(前提..._excel导入pl/sql

Git常用命令速查手册-程序员宅基地

文章浏览阅读83次。Git常用命令速查手册1、初始化仓库git init2、将文件添加到仓库git add 文件名 # 将工作区的某个文件添加到暂存区 git add -u # 添加所有被tracked文件中被修改或删除的文件信息到暂存区,不处理untracked的文件git add -A # 添加所有被tracked文件中被修改或删除的文件信息到暂存区,包括untracked的文件...

分享119个ASP.NET源码总有一个是你想要的_千博二手车源码v2023 build 1120-程序员宅基地

文章浏览阅读202次。分享119个ASP.NET源码总有一个是你想要的_千博二手车源码v2023 build 1120

【C++缺省函数】 空类默认产生的6个类成员函数_空类默认产生哪些类成员函数-程序员宅基地

文章浏览阅读1.8k次。版权声明:转载请注明出处 http://blog.csdn.net/irean_lau。目录(?)[+]1、缺省构造函数。2、缺省拷贝构造函数。3、 缺省析构函数。4、缺省赋值运算符。5、缺省取址运算符。6、 缺省取址运算符 const。[cpp] view plain copy_空类默认产生哪些类成员函数