浅谈自然语言处理(NLP)学习路线(一)--- 概述_自然语言处理学习路线-程序员宅基地

技术标签: 大道至简系列 python 机器学习 深度学习 学习经验分享 人工智能 # 自然语言处理系列 自然语言处理

资料汇总:

引流:大道至简之机器学习系列

《流畅的python》:https://pan.baidu.com/s/1l5Tl0yZS0NTixAilH9S2aQ 提取码:38qa

《统计学习方法第二版》:https://pan.baidu.com/s/18pg6dUMcMciyO5ZXMrbUJg 提取码:pb7r

西瓜书《机器学习》-周志华:https://pan.baidu.com/s/1mpU-4hfUcVGcjNckjWp6hw 提取码:9yr8

南瓜书(西瓜书公式详解):https://pan.baidu.com/s/1rs6VBcNPf6y6Fda3jDqebA 提取码:k35z

部分论文:seq2seq、word2vector、elmo、transformer、bert 提取码:c3u2

本篇文章属于概述介绍性文章,仅适合于帮助对NLP感兴趣想入门的读者或者准备转行从事NLP的读者来对NLP有一个笼统了解,因此没有太多的细节陈述和公式推导。如果有幸被NLP大佬们阅读,还望多多指出本文瑕疵,给出批评意见,笔者甚为感激!

目录

文档撰写习惯,先抛出总结:

本篇博客泛泛介绍了学习NLP应当练好哪些基础,才能够持续性提升, 这里推荐一个学习网站:ai-learning。

NLP基础学习路线总结:

1. 数学基础:重点是函数性质、导数(特别是对矩阵求偏导)、不同概率的定义和性质、数学期望、参数估计、梯度下降法

2. 机器学习:重点是LR、Xgboost、HMM、CRF

3. 传统文本算法: n-gram、tf-idf、textrank、lda

4. 经典神经网络语言模型:LSTM、NNLM、word2vector、fasttext

5. 进阶神经网络语言模型:elmo、transformer、gpt、bert

一、拉齐认知

众所周知,视觉和语言绝对是人工智能的两大要素,在人工智能领域,视觉涉及到图像识别、目标检测、语义分割、图像变换(风格转换等)、图像生成等,商业应用涉及到自动驾驶、视频安全、视频运营等行业的关键帧抽取、精彩片段抽取、姿态估计、行为识别等;自然语言处理涉及到文本分类、文本聚类、实体识别&抽取、摘要提取、关键词抽取、新词发现、文本生成、翻译问答等,商业应用涉及到家用&工业智能、网络安全等行业中语音转文、图谱构建、即时翻译、舆情分析、内容质量评估等。

以上视觉图像处理和自然语言处理作为基础技术结合起来,还能辅助提升搜广推技术在商业一线场景的变现能力。因此,市场上对图像和语言类算法的人才需求仍然很大,虽然受经济环境影响,岗位需求有所收紧,但收紧的目的是提高招聘门槛,提高用人质量,并非这些技术不管用了,不管是图像还是语言,只有踏踏实实一步一个脚印的去啃,才能提升自己的硬实力。只要技术够硬,就不要去忧前景之虑,这一点希望行业小伙伴们能够拉齐认知。

很多人对于NLP的认识或多或少都有它是一门不够成熟的技术的印象。的确,如果它已经足够成熟了,那还有我们什么事,也正是因为它不够成熟,才会有更多的挑战和机会等着我们去挖掘,我们才有更大的概率成为强者。我们清楚,在人类文明发展历史中,视觉是先于语言出现的,所以难免图像技术发展的比自然语言处理技术要更为充分。一副图像,我们看到是什么样,那它就客观的是什么样,但语言不同,很多时候,你说一句话,它可能夹杂着太多的情绪和内涵在里面,如何能够让计算机理解一句话,正是我们NLP面临的巨大挑战之一,所以如果缺少NLP技术的佐助,人工智能只能是个“聋子”,为什么说是“聋子”,是因为以后我们传入给机器的很可能是语音,语音再转文字让机器理解,这也反映了自然语言处理和语音处理技术是密不可分的。因此我认为,NLP仍然还有非常多的非常有意义的课题值得我们去研究。

二、从事NLP需要具备哪些基础技能

1. 开发工具

开发工具包括编程语言、常用包,编程语言个人比较建议Python,其编程风格可读性好,易懂好上手。对于没有基础的同学,可以阅读一些Python的基础入门书籍,这里不作过多推荐。对于有一定基础的同学,强烈推荐大家读一读《流畅的Python》这本书。电子书传送门:https://pan.baidu.com/s/1l5Tl0yZS0NTixAilH9S2aQ 密码: 38qa

至于编程平台,学习阶段可以使用jupyter notebook,工程开发阶段推荐使用Pycharm。

Linux常用命令一定要会,我们工作环境基本都是在无图形界面的Linux系统中,打交道最多的就是服务器,所以要从感性层面熟悉Linux系统。

Java和SQL也需要会基础,因为在工作中,模型的线上服务接口开发和部署几乎都会是基于Java去做的。而SQL是因为很多公司大量的数据都是存在后台数据库中,很多时候需要你自己写SQL代码查询、筛选和处理数据,除此之外,还要掌握一些基础的ES(Elasticsearch)搜索语句,由于它强大的搜索性能,现在被广泛应用在搜索推荐场景。将数据导出后,才适合用Python做进一步的数据分析处理。

谈到数据分析处理,这是NLP非常重要的一步,有句话说的很好:数据质量决定了指标的上限,模型优化只是在不断逼近这个上限。因此,算法工程师一定要懂得数据先行的道理。python中的pandas包对于数据分析是非常好用的,建议同学们花时间重点学一下它,pandas一般用在分析数据分布,组合数据,筛选数据等。此外,正则表达式也是一个非常常用技术,一般会用它来清洗数据中的一些噪声,例如html标签、url、特殊字符等。如果是较为简单的数据匹配,例如通过一些关键词来筛选数据,有时候前缀树Trie树也是一个非常好用的辅助工具,它的匹配效率比正则匹配高很多。Trie树有python实现的接口,参考 https://github.com/abusix/ahocorapy。具体的数据分析处理方法,还需要具体问题具体分析,这里只做普及式介绍。

2. 机器学习

参考学习资料:

书籍:见文章开头

我把NLP的技术分为两大类:基于机器学习的传统NLP技术和基于深度学习的新兴NLP技术。其实图像也是如此。但不管是哪一类,我都想首要的抛出我的观点,学习NLP,一定要先掌握经典机器学习算法。为什么呢?就我个人经验来看,人工智能不管如何发展,最后究其祖先,都仍然脱离不了机器学习算法的影子,而机器学习无非就是包了一层高级外衣的概率论与数理统计原理。所以,先学好常见机器学习算法!

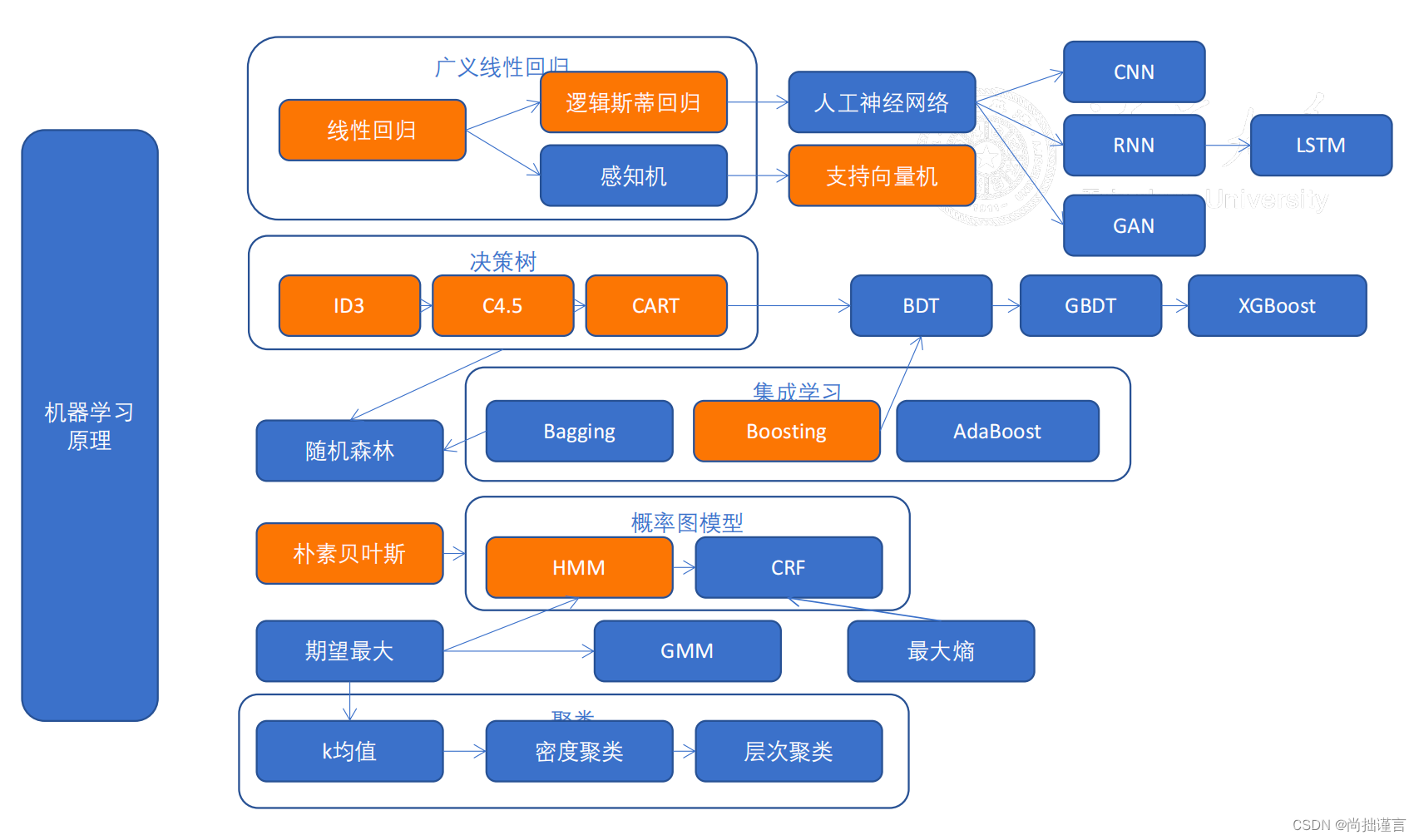

关于机器学习的学习路线,这里有张我个人认为总结的比较好的图分享给大家(图2-1):

大家可订阅笔者的专栏-大道至简系列之机器学习系列,我会跟着大家一起学习,持续更新,这里大家参照上图先有个印象。

3. 数学基础

不管是深度学习还是机器学习都包含了大量数学的内容,因此大家必须对数学基础也应当有所掌握,最常见的就是微积分、概率论、统计学、矩阵论、数值分析,因为这些都涉及到机器学习算法的一些公式由来,和一些优化方法的原理。依我个人见解,并不是说非要全部掌握相关的数学原理,毕竟除了业界的少数大佬,我相信大部分玩儿机器学习和深度学习的小伙伴并非纯数学专业和数学领域的专家,我们在学习的过程中,一定要有的放矢,对于一些核心的公式我们要重点吃透,用到哪里学到哪里,先把基本概念厘清,先把重点结论记住并跟着学习资料尝试推导,遇到不懂的地方,先做个标记,等全部学完,并coding实战过,再回过头来,把之前不懂的地方搞清楚,这个时候很可能需要延伸查阅许多辅助资料,过程很痛苦,但是我希望大家能坚持下来。如果遇到一些需要追溯到上古时代的数学原理,我个人建议不要去死扣,记住结论即可,例如EM算法中的Jensen不等式,如果有精力,可以去尝试推导证明一下它是怎么来的,如果精力有限,那么记住它的结论即可,除非今后真的遇到必须理解它的证明过程才能进行下去的工作再去学也不迟。

总结来说,要了解的数学知识有:

(1)概率论与数理统计:联合概率、条件概率、概率密度、概率分布、数学期望、参数估计等;

(2)高等数学:微积分、几何基础、函数(连续性、收敛性、凸函数等)、极限等;

(3)线性代数:矩阵运算、矩阵求导、矩阵变换,可行解分析等;

(4)数值分析:二分法、牛顿法、最小二乘法、最速下降法等;

感觉很琐碎有木有,还是那句话,用到哪学到哪,学到哪,查到哪。

4. 基于统计学的文本处理算法

说两个比较经典的基于统计学的文本处理算法:统计语言模型(N-Gram)和TF-IDF,n-gram模型一般用来判断一段文字是否符合自然语法,tf-idf一般用来做关键词提取或者词过滤,在搜索推荐场景也会用来做词权重计算。对于关键词提取,还有个很有名的算法是textrank,GitHub上有个中文的textrank开源实现:https://github.com/letiantian/TextRank4ZH

tf-idf使用前提是基于多篇文档来计算的,每个词不仅需要考虑在其所在文章中的出现频率,还要考虑在一堆文章中出现的情况,而textrank仅针对一篇文章就能计算出关键词 ,这是因为tf-idf算法是纯统计类的,而textrank用到了图计算的概念,这里先不展开,后续有机会补上。

TF-IDF公式补充:

i是第i个词,j是wi所在的第j篇文章,N是第j篇文章所有词之和。TF就是某篇文章中某个词出现的频率;

D是所有文章数之和,dj是第j篇文章。IDF指的是文章数之和与包含某个词的文章数之和的比值。

由公式可以看出,当某个词在一篇文章中出现的次数多而在其它文章中出现的少,TF-IDF值越大,说明该词在本篇文中的重要性高。

我重点讲一下n-gram模型,因为它和我们后面的Bert等语言模型有着发展脉络的关系。简单来讲,n-gram模型是个纯粹的语言模型,但是是基于统计的语言模型,它的算法思想由来起源于我们人类的语言习惯。例如“我热爱自然语言处理技术”和“我热情自然话语处理技术”这两句话,n-gram模型能够判断出哪句话符合人类语言习惯的概率较大,直观上,我们一眼就能看出前一句更符合我们的语言习惯。对于模型来说,它是怎么做到的呢?是这样的,当我们喂给模型足够多的正规语言样本后,经过统计,它能够算出每个字或者词与后续的字词组合起来的概率有多大,例如上面的例子,当我们的训练样本中出现的是“我热爱自然语言处理技术”,那么在测试样本中,它就会根据由训练样本统计出来的词表计算:“我”出现的条件下“热爱”出现的概率,“我热爱”出现的条件下,“自然”出现的概率,以此类推,最终就是

P("我, 热爱, 自然, 语言, 处理, 技术") =

P("我")P("热爱"|"我")P("自然"|"我, 热爱")P("语言"|"我, 热爱, 自然")P("处理"|"我, 热爱, 自然, 语言")P("技术"|"我, 热爱, 自然, 语言, 处理")

也就是第t个单词出现的概率与前 i 到 t-1 个单词相关:

对于上述公式能求出这段文字的一个概率,当然,我这里只是为了大家有个直观感受,写的过于简单,实际操作要更复杂一些。看,这其实就是求似然概率。n-gram中的n表示限制每次要计算相邻的n个词的似然值。

除了上述介绍的算法之外,作为NLP算法工程师还应当掌握隐马尔科夫模型(HMM)、条件随机场(CRF),因为它们和命名实体、分词、词性标注等实际任务都有很强的关联,特别是近几年Bert的爆发,已经有很多实验证明,Bert+CRF在做实体识别、词性标注等任务上的效果非常可观,而隐马尔科夫模型的另一个重要应用场景就是语音识别,李开复先森就是用它,完成了卡内基梅隆大学的博士毕业论文。可见这两个算法是如此的重要。当然,它们也属于机器学习算法的范畴,以后慢慢再道。其它的算法我没介绍到,并不是不重要,有没有一种可能,就是本人没有考虑到,亦或是我在实际工作中用到的比较少。总之,欢迎小伙伴们进行补充哈~

5. 基于深度学习的文本处理

介绍完传统文本处理算法,终于到了我们的重头戏了,那就是基于神经网络的文本处理模型了。不过要抱歉的是,这方面内容比较多比较杂,所以我按照比较经典的模型有选择性的进行脉络简述,细节上,我会在往后的博客里会跟着大家一起品~

5.1 神经网络语言模型(NNLM)

第一个我想介绍的是神经网络语言模型(NNLM),有一些童鞋比较少听说过这个网络,感觉它很低调,但是我个人认为,这是个非常经典的NLP基础网络,是一款非常适合基于深度神经网络的NLP入门的模型。可以认为它是n-gram模型的高级版,因为它利用神经网络技术对公式

进行了描述,与此同时,NNLM网络中做了词嵌入的工作,因此它还生成了后面会讲到的非常有名的word2vector模型原形。所以我认为它在传统文本算法和神经网络文本算法中间起到了承上启下的重要纽带作用。而且该网络中还用到了残差的思想,这一设计在目前非常著名的Transformer模型中也有应用,所以我说,NNLM虽然简单,但是非常经典和重要,想学NLP的小伙伴,应当对它有所掌握。

NNLM模型可以用以下公式描述:

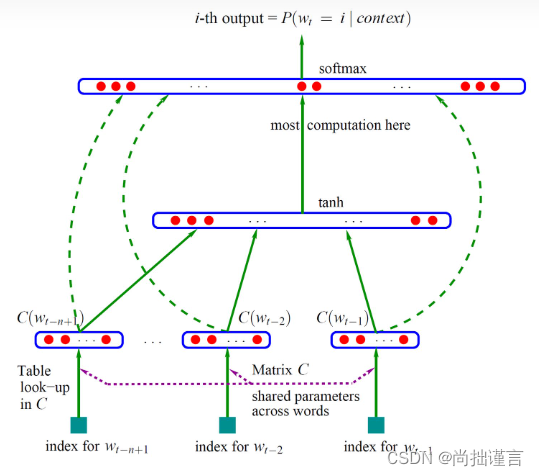

y是网络的输出,b+Wx是线性层,和我们的线性回归是一样的,W、U、d、H都是一些权值矩阵,x是网络的输入。简而言之,它是由一个线性组份b+Wx和一个非线性层组成的。它的网络结构长这样(图5-1-1):

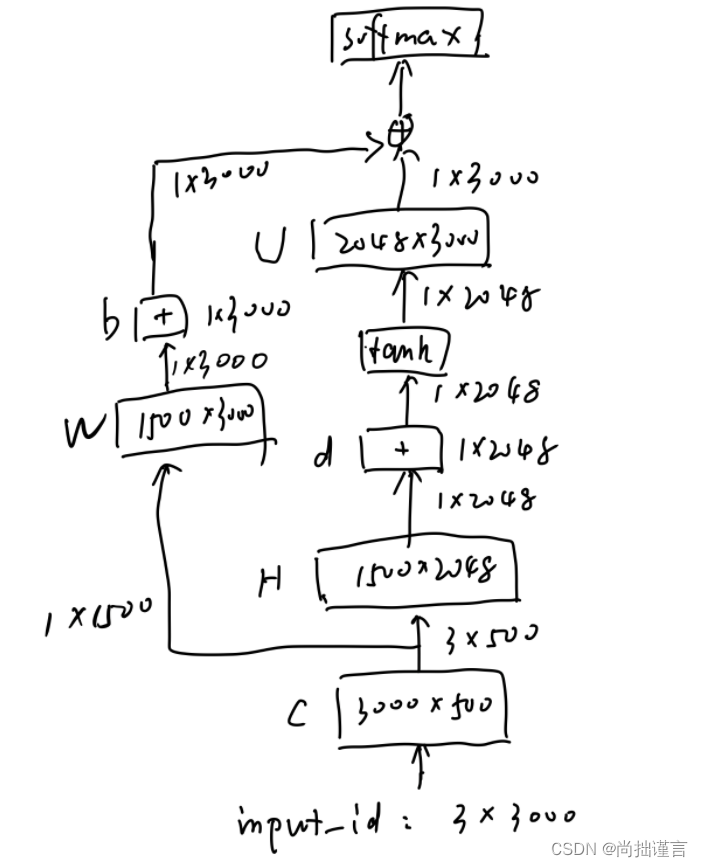

学网络一定要从维度变换学起,那么把这个图转换成维度变换图(图5-1-2):

有点丑,以后具体介绍该网络的时候再补个美颜版的哈~

上图中,input-id是one-hot形式的向量,3是网络输入文本的大小,3个词,比如‘我’、‘爱’,‘你’。3000是我们预先定义好的词表,有3000个词,那么input-id每一行中,每个输入词在3000词表里对应的位置为1,其余位置为0。

对于网络的输出y,其实还有一层处理,就是softmax,它能够将一次输出的所有预测值映射到0~1之间,转换成概率值,且所有概率值之和为1,最大的那个概率值所在的位置就是我们要预测的单词。对于softmax的介绍,网上有太多了,而且一看就懂,这里不再赘述。

5.2 Word2Vector

这是个非常有名的模型,而且我个人猜测,NLP之星Bert十有八九也是或多或少受到这个模型的启发而设计出来的。word2vector这个模型吧,有两种实现方式:CBOW和Skip-gram。对于一段文本,第一一个滑动窗口大小,那么窗口每滑到文本的一个位置,就用窗口内的周围此预测窗口内的中心词,这种方式叫做CBOW,同理,用窗口内的中心词预测窗口内的剩余词,这种方式叫Skip-gram。了解Bert的同学有木有感觉很熟悉?

在n-gram模型中,它只能统计每个词的分布,但无法考虑每个词的上下文语义信息,这对于自然语言的理解是非常不利的。而在word2vector中,由于工作机制的不同,它能够兼顾每个词上下文的语义信息,显然它的表现会比n-gram好很多。

在图5-1-2中,input-id是我们要输入的3个词的one-hot,它和C点乘能够得到3个词的向量表示,这个C就是word2vector的前身。所以只要训练好C,那么我们就能够得到词表范围内任意词的向量表示,这个向量表示可以用在超级多的地方,例如相似词检索(两个词向量求余弦距离)、相似文本判断(多个词向量)、文本分类等。

最后补充一句,word2vector有一个更高级的优化版-fasttext。

5.3 长短时记忆网络(LSTM)

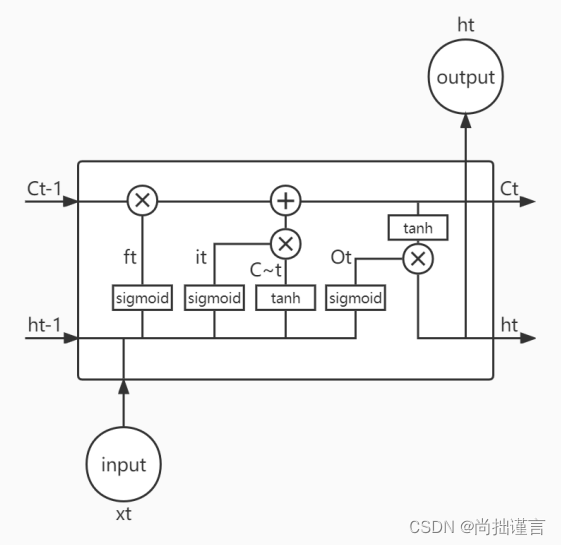

LSTM属于RNN网络,它是个序列模型,因此对处理同为序列样本的文本来说非常适合,所以LSTM是不得不掌握的另一个重要网络。网上关于该网络的介绍都烂大街了,感兴趣的小伙伴可以自行查阅,如果有需要我专门出一篇文章讲它的,可以私信留言~

这里只强调两点:LSTM的网络结构以及LSTM的重要公式

(1)LSTM网络结构:

(2)LSTM的重要公式

遗忘门:

输入门:

候选集:

更新门:

输出门:

隐向量输出:

以上内容必须熟记,图要会画,公式要会写,而且每个公式都能和图对应起来解释。

一般来讲,一段文字输入到LSTM单元后,我们可以取每一步输出的ht,接一些后续计算实现词性标注、实体等任务,也可以取最后一步输出的ht接一个线性层做文本分类,或者直接把它当成段文字的向量表示用作向量检索。

补充一点内容,我们平常所说的seq2seq,其实并不是一种模型,而是泛指序列到序列的任务,例如翻译、问答等,它是由Encoder-Decoder框架组成的,而其中的encoder和decoder,又是由各种神经网络组成的,比如它们可以是LSTM、GRU、CNN、Transformer等。

5.4 进阶神经网络语言模型

5.1~5.3我们介绍了一些传统的经典NLP神经网络,我认为要入门NLP,对于神经网络部分的学习,这些是基础中的基础了。后面的像基于Transformer的Bert及其变种、XLNet、elmo、T5、GPT系列等高级神将网络,基本都是在这些基础网络的结构上做比较深层次的改进和发展了,所以,千里之行始于足下,一定要注重基础知识的学习!

一方面,高级神经网络一直在出新,没有一一介绍的必要,也没有可能介绍完,当然后期我会持续性的撰写相关博客和大家一起交流学习。另一方面,本着以不变应万变的哲学观,本节就简单的告诉大家,对于高级神经网络我认为应该先学会哪些。

第一:Transformer。特别是对于自注意力机制,一定要弄懂,我会专门抽一期讲这个网络;

第二:elmo。它也是传统神经网络向高级神经网络进阶的枢纽;

第三:GPT。它是第一个基于Transformer应用的高级神经网络,理解它,就能对比的理解Bert为何而来;

第四:Bert。其重要性我就不用多说了,一定要深入掌握,它是自Bert诞生到现在,各种新兴高级神经网络的基石,像ALBert、RoBerta、XLNet、T5等,都是基于它的各种优化变种。

6. 算法开发常用的工具库

作为NLP算法工程师,一些常用的开源包应该能够熟练使用,这里列举几种:

sklearn:机器学习算法集成包,包含了大部分机器学习算法以及数据处理和可视化API;

transformers:pytorch版的各种深度神经网络语言模型实现,目前该库已经封装成了api,并提供了许多预训练模型,模型定义在src/transformers/models下,推荐阅读模型源码;

nltk:自然语言处理工具包,涵盖了大量NLP任务接口;

gensim:也是一个自然语言处理库,涵盖了常用的传统自然语言处理算法;

jieba:最常用的分词工具,它还包含了词性标注、关键词抽取等功能;

三、总结

本篇博客泛泛介绍了学习NLP应当练好哪些基础,才能够持续性提升, 这里推荐一个学习网站:ai-learning。

好了,告一段落,对NLP基础学习路线做个总结:

1. 数学基础:重点是函数性质、导数(特别是对矩阵求偏导)、不同概率的定义和性质、数学期望、参数估计、梯度下降法

2. 机器学习:重点是LR、Xgboost、HMM、CRF

3. 传统文本算法: n-gram、tf-idf、textrank、lda

4. 经典神经网络语言模型:LSTM、NNLM、word2vector、fasttext

5. 进阶神经网络语言模型:elmo、transformer、gpt、bert

由于时间有限,写的比较仓促,希望各位读者对文中出现的错误之处能及时指出并给与批评,感谢关注!

智能推荐

c# 调用c++ lib静态库_c#调用lib-程序员宅基地

文章浏览阅读2w次,点赞7次,收藏51次。四个步骤1.创建C++ Win32项目动态库dll 2.在Win32项目动态库中添加 外部依赖项 lib头文件和lib库3.导出C接口4.c#调用c++动态库开始你的表演...①创建一个空白的解决方案,在解决方案中添加 Visual C++ , Win32 项目空白解决方案的创建:添加Visual C++ , Win32 项目这......_c#调用lib

deepin/ubuntu安装苹方字体-程序员宅基地

文章浏览阅读4.6k次。苹方字体是苹果系统上的黑体,挺好看的。注重颜值的网站都会使用,例如知乎:font-family: -apple-system, BlinkMacSystemFont, Helvetica Neue, PingFang SC, Microsoft YaHei, Source Han Sans SC, Noto Sans CJK SC, W..._ubuntu pingfang

html表单常见操作汇总_html表单的处理程序有那些-程序员宅基地

文章浏览阅读159次。表单表单概述表单标签表单域按钮控件demo表单标签表单标签基本语法结构<form action="处理数据程序的url地址“ method=”get|post“ name="表单名称”></form><!--action,当提交表单时,向何处发送表单中的数据,地址可以是相对地址也可以是绝对地址--><!--method将表单中的数据传送给服务器处理,get方式直接显示在url地址中,数据可以被缓存,且长度有限制;而post方式数据隐藏传输,_html表单的处理程序有那些

PHP设置谷歌验证器(Google Authenticator)实现操作二步验证_php otp 验证器-程序员宅基地

文章浏览阅读1.2k次。使用说明:开启Google的登陆二步验证(即Google Authenticator服务)后用户登陆时需要输入额外由手机客户端生成的一次性密码。实现Google Authenticator功能需要服务器端和客户端的支持。服务器端负责密钥的生成、验证一次性密码是否正确。客户端记录密钥后生成一次性密码。下载谷歌验证类库文件放到项目合适位置(我这边放在项目Vender下面)https://github.com/PHPGangsta/GoogleAuthenticatorPHP代码示例://引入谷_php otp 验证器

【Python】matplotlib.plot画图横坐标混乱及间隔处理_matplotlib更改横轴间距-程序员宅基地

文章浏览阅读4.3k次,点赞5次,收藏11次。matplotlib.plot画图横坐标混乱及间隔处理_matplotlib更改横轴间距

docker — 容器存储_docker 保存容器-程序员宅基地

文章浏览阅读2.2k次。①Storage driver 处理各镜像层及容器层的处理细节,实现了多层数据的堆叠,为用户 提供了多层数据合并后的统一视图②所有 Storage driver 都使用可堆叠图像层和写时复制(CoW)策略③docker info 命令可查看当系统上的 storage driver主要用于测试目的,不建议用于生成环境。_docker 保存容器

随便推点

网络拓扑结构_网络拓扑csdn-程序员宅基地

文章浏览阅读834次,点赞27次,收藏13次。网络拓扑结构是指计算机网络中各组件(如计算机、服务器、打印机、路由器、交换机等设备)及其连接线路在物理布局或逻辑构型上的排列形式。这种布局不仅描述了设备间的实际物理连接方式,也决定了数据在网络中流动的路径和方式。不同的网络拓扑结构影响着网络的性能、可靠性、可扩展性及管理维护的难易程度。_网络拓扑csdn

JS重写Date函数,兼容IOS系统_date.prototype 将所有 ios-程序员宅基地

文章浏览阅读1.8k次,点赞5次,收藏8次。IOS系统Date的坑要创建一个指定时间的new Date对象时,通常的做法是:new Date("2020-09-21 11:11:00")这行代码在 PC 端和安卓端都是正常的,而在 iOS 端则会提示 Invalid Date 无效日期。在IOS年月日中间的横岗许换成斜杠,也就是new Date("2020/09/21 11:11:00")通常为了兼容IOS的这个坑,需要做一些额外的特殊处理,笔者在开发的时候经常会忘了兼容IOS系统。所以就想试着重写Date函数,一劳永逸,避免每次ne_date.prototype 将所有 ios

如何将EXCEL表导入plsql数据库中-程序员宅基地

文章浏览阅读5.3k次。方法一:用PLSQL Developer工具。 1 在PLSQL Developer的sql window里输入select * from test for update; 2 按F8执行 3 打开锁, 再按一下加号. 鼠标点到第一列的列头,使全列成选中状态,然后粘贴,最后commit提交即可。(前提..._excel导入pl/sql

Git常用命令速查手册-程序员宅基地

文章浏览阅读83次。Git常用命令速查手册1、初始化仓库git init2、将文件添加到仓库git add 文件名 # 将工作区的某个文件添加到暂存区 git add -u # 添加所有被tracked文件中被修改或删除的文件信息到暂存区,不处理untracked的文件git add -A # 添加所有被tracked文件中被修改或删除的文件信息到暂存区,包括untracked的文件...

分享119个ASP.NET源码总有一个是你想要的_千博二手车源码v2023 build 1120-程序员宅基地

文章浏览阅读202次。分享119个ASP.NET源码总有一个是你想要的_千博二手车源码v2023 build 1120

【C++缺省函数】 空类默认产生的6个类成员函数_空类默认产生哪些类成员函数-程序员宅基地

文章浏览阅读1.8k次。版权声明:转载请注明出处 http://blog.csdn.net/irean_lau。目录(?)[+]1、缺省构造函数。2、缺省拷贝构造函数。3、 缺省析构函数。4、缺省赋值运算符。5、缺省取址运算符。6、 缺省取址运算符 const。[cpp] view plain copy_空类默认产生哪些类成员函数