Learning pyspark It is estimated that in 2013 the whole world produced around 4.4 zettabytes of data; that is, 4.4 billion terabytes! By 2020, we (as the human race) are expected to produce ten times ...

”pyspark“ 的搜索结果

使用pyspark的API,从hdfs中读取csv文件,并把统计的在线人数信息按日期分区插入到hive表中

一种方法: File –> Default Setting –... 再次在python文件中写入如下 from pyspark import SparkConf 如果上一种不管用,则采用下一种。 With PySpark package (Spark 2.2.0 and later) 另一种操作方法: 1.Go to

主要介绍了pyspark 随机森林的实现,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧

一、windows下配置pyspark环境 1.1 jdk下载安装 1.2 Scala下载安装 1.3 spark下载安装 1.4 Hadoop下载安装 1.5 pyspark下载安装 1.6 anaconda下载安装 1.7 测试环境是否搭建成功 二、pyspark原理简介 三、...

文章《windows10配置spark与pyspark》安装包第一部分,由于文件较多,分两批上传,

主要介绍了pyspark读取parquet数据过程解析,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友可以参考下

terraform-emr-pyspark:使用Terraform在AWSEMR上使用Anaconda快速入门PySpark

PySpark大数据处理及机器学习Spark2.3视频教程,本课程主要讲解Spark技术,借助Spark对外提供的Python接口,使用Python语言开发。涉及到Spark内核原理、Spark基础知识及应用、Spark基于DataFrame的Sql应用、机器学习...

pyspark读取hive数据非常简单,因为它有专门的接口来读取,完全不需要像hbase那样,需要做很多配置,pyspark提供的操作hive的接口,使得程序可以直接使用SQL语句从hive里面查询需要的数据,代码如下: from pyspark...

You will start by getting a firm understanding of the Spark 2.0 architecture and how to set up a Python environment for Spark., You will get familiar with the modules available in PySpark. You will ...

资源分类:Python库 所属语言:Python 使用前提:需要解压 资源全名:pyspark_sparkutils-0.0.1-py3-none-any.whl 资源来源:官方 安装方法:https://lanzao.blog.csdn.net/article/details/101784059

PySpark线性回归

标签: 机器学习

利用Python调用spark接口训练线性回归模型,详细介绍了PySpark的使用,包含:数据准备、数据探索、特征工程和模型训练

主要介绍了pyspark操作MongoDB的方法步骤,小编觉得挺不错的,现在分享给大家,也给大家做个参考。一起跟随小编过来看看吧

火花 <스파크를다루는기술>(2018年6月)학습용으로정리한다。 출처-Petar Zecevic외1명。 <스파크를다루는기술(Spak in Action)>。 이춘오。 길벗(2018) 类别4스파크API 配对RDD ... 数据框

pyspark数据管道

数据台和 Spark 此演示在本地运行pyspark并与接口。 在 Mac 上,运行brew install apache-spark来安装spark和pyspark 。 作为测试,您可以运行pyspark helloworld_standalone.py 。 对于 Databench,运行pip install...

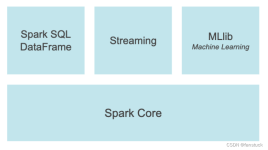

Spark是什么Apache Spark是用于。

python库,解压后可用。 资源全名:pyspark_hnsw-0.45-py2-none-any.whl

微博分析与PySpark中的芝加哥大学相关的推文。

Learn PySpark

标签: java

Learn PySpark

使用PySpark的贷款默认预测 使用Lending Club中包含100万以上行的数据集将贷款预测为违约/非违约 整个项目是在单个群集的Databricks云环境中完成的

PySpark_Housing_Models 三种PySpark机器学习模型可预测房屋与海洋的距离

Spark-PySpark-Big-Data:Spark和PySpark处理大数据

主要介绍了PyCharm搭建Spark开发环境实现第一个pyspark程序,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧

推荐文章

- Redis Sentinel机制与用法[转]_sentinel: redis://10.43.19.251:26379 频繁 added down-程序员宅基地

- HTML页面获取URL传递的参数值_html获取url地址中携带的参数-程序员宅基地

- SQL Server 配置管理器无法启动_sql服务设置时wmi无效参数-程序员宅基地

- php导出筛选后的数据_问卷星数据导出、筛选与分析-程序员宅基地

- 初次联系导师短信模板_20考研注意了:选导师应该关注哪些方面呢?-程序员宅基地

- Android零基础入门第52节:自定义酷炫进度条_android mprogress_horizontal-程序员宅基地

- Zookeeper设置访问权限-程序员宅基地

- SpringMVC——核心技术:异常处理(@ExceptionHandler、@ControllerAdvice)_spring @exceptionhandler message-程序员宅基地

- 操作系统文件系统实验报告16281027_i/o磁盘实验报告-程序员宅基地

- dwd明细粒度事实层设计_dwd层如何设计-程序员宅基地