”梯度下降参数不收敛“ 的搜索结果

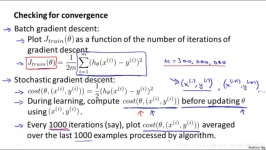

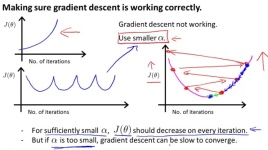

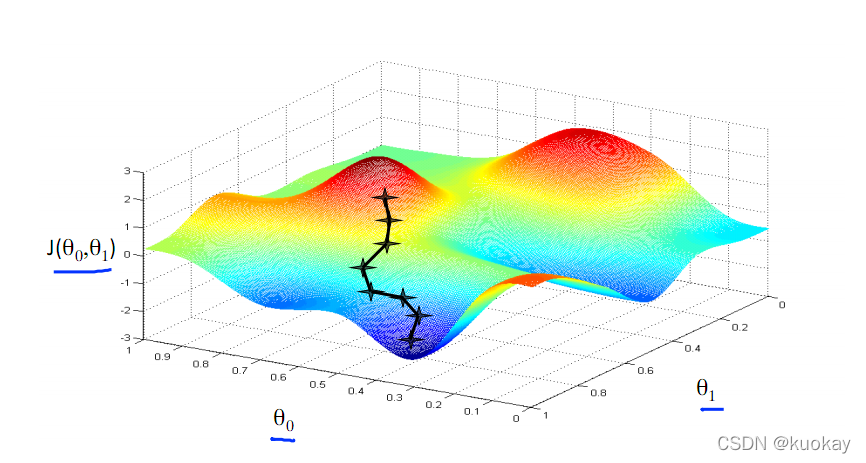

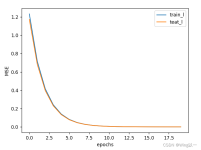

批量梯度下降 定义:批量梯度下降的一次训练喂入训练集中的所有数据,使用所有数据来更新权重,也就是batch_size=训练集大小 ...所以学习中不确定性和震荡性会增大,收敛路径不平滑 小批量梯度下降 定义

理论模拟仿真了基于变形镜与随机并行梯度下降(SPGD)算法的无波前探测自适应光学系统(AOS)。为提高基于SPGD算法的无波前探测AOS的收敛速度,在不降低精度的前提下,对SPGD算法中关键参数随机扰动幅值和增益系数的关系...

随机梯度下降(Stochastic Gradient Descent)算法—收敛速率证明 1.需证明公式: 2.证明过程:

确定性优化算法和随即优化算法是有明显的分界线的。...从梯度下降(GD)后,20世纪50年代,各种一阶算法井喷,其中 SGD 也是这个时候的产物。 梯度下降(GD)是柯西(Cauchy )大神的1847年提出的。其基本思想是...

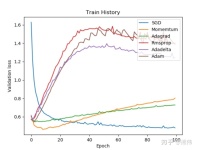

全梯度下降算法(FGD)、随机梯度下降算法(SGD)、随机平均梯度下降算法(SAGD)、小批量梯度下降算法(Mini-batch gradient descent,MGD)梯度下降优化算法,动量法、Adagrad、Adadelta、RMSProp、Adam

LM算法[4]是一种利用标准数值优化技术的快速算法,具有 高斯牛顿法 的局部收敛性和梯度下降法的全局特性,在局部搜索能力上强于梯度下降法。LM算法基本思想是先沿着负梯度方向进行搜索,然后根据牛顿法在最优值附近...

随机梯度下降法,支持动量参数,支持学习衰减率,支持Nesterov动量 参数: lr:大或等于0的浮点数,学习率 momentum:大或等于0的浮点数,动量参数 decay:大或等于0的浮点数,每次更新后的学习率衰减值

一 序 本篇属于贪心NLP训练营学习笔记。 二 逻辑回顾的梯度下降法 逻辑回顾的目标函数: ...推导过程:NLP学习笔记21-逻辑回归2:决策...三 Convergence Analysis of Gradient Descent梯度下降法的收敛分析 1. ...

它是一种改进的梯度下降法,通过引入一个“动量”项,使得参数更新在梯度方向上有一定的“惯性”,从而加速收敛。NAG算法在深度学习中被广泛应用,尤其是在训练深度神经网络时,NAG算法往往能够比传统的梯度下降法更...

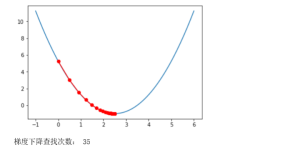

但每次迭代中只使用一个样本计算梯度,因此每次迭代的梯度都是有噪声的,毕竟不是所有样本的均值,所以下降(下山)会走一点弯路,但总体因为总的迭代次数很多,所以随机梯度下降法最终会收敛到最优解 ,还是划得来...

深入理解梯度下降法:从原理到实践

标签: 神经网络

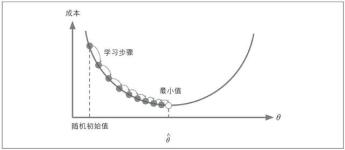

本博客将深入探讨梯度下降法的原理、不同变种、超参数调优和实际应用,帮助您全面理解这一关键概念。 目录 介绍 什么是梯度下降法? 为什么需要梯度下降法? 梯度下降法的原理 目标函数与损失函数 梯度的定义 梯度...

第一种方法:随机梯度下降法 对偶形式的算法: 对哦算法更新的内容少了 算法收敛性 给定一个约束,使得参数的二范数是1. 第一个公式证明,只要另r等于前面那个最小的就行。 第二个公式的证明: k是误分类点修正...

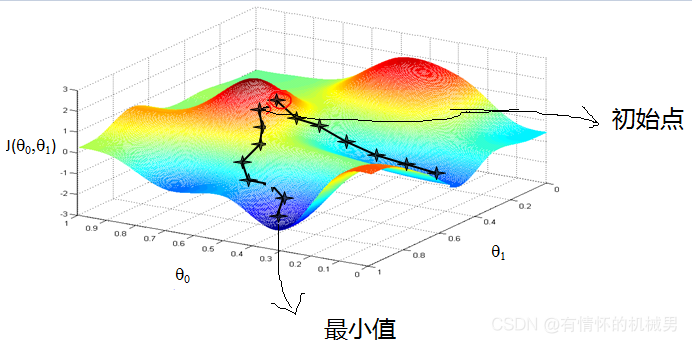

梯度下降法(Gradient Descent)是一种常用的优化算法,用于在训练机器学习模型时最小化损失函数(即误差)。...梯度下降法的目标就是找到损失函数的最小值点,更新模型参数使得损失函数达到最小值。

现在多使用小批量随机梯度下降算法来进行梯度的更新。

推荐文章

- Response使用 application/octet-stream 响应到前端_application/octet-stream;charset=utf-8-程序员宅基地

- 利用MultipartFile实现文件上传_实现了multipartfile file上传文件时要选择一个栏目,传给后端一个栏目id,如何实现-程序员宅基地

- muduo之Singleton_muduo singleton-程序员宅基地

- html5 动态存储 localStorage.name 和localStorage.setItem()的差别_localstorage.setitem('aa')和localstorage.aa一样吗-程序员宅基地

- 02.loadrunner之http接口脚本编写_http脚本-程序员宅基地

- The server time zone value ‘�й���ʱ��‘ is unrecognized or represents more than one time zone.-程序员宅基地

- 如何打造企业短视频账号的人设?_做的比较有人格化的公司短视频账号-程序员宅基地

- 一个会做饭的程序员如何每天给女朋友带不同的便当?-程序员宅基地

- PendingIntent重定向:一种针对安卓系统和流行App的通用提权方法——BlackHat EU 2021议题详解 (下)_getrunningservicecontrolpanel-程序员宅基地

- python 之 面向对象(反射、__str__、__del__)-程序员宅基地