”梯度下降的超参数大于等于2什么意思“ 的搜索结果

YOLO: Real-Time Object Detectiondarknet模型结构与训练超参数是由cfg文件定义的。YOLO模型的cfg参数定义在版本发展过程中也有过变更。本文针对YOLOv3,解读[net]和[yolo]的参数定义,特别是与模型训练和优化直接...

基于梯度下降的参数辨识代码,分析了定常和时变系统在不同学习率调整规则下的辨识结果。在MATLAB 的AppDesigner设计工具上制作了参数辨识面板。

主要介绍了Keras SGD 随机梯度下降优化器参数设置方式,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧

介绍在这篇文章中,我们将了解什么是真正的梯度下降,为什么它变得流行,为什么AI和ML中的大多数算法都遵循这种技术。在开始之前,梯度下降实际上意味着什么?听起来很奇怪对吧!柯西是1847年第一个提出梯度下降的人...

1.0梯度下降的三种方式: 1.1批量梯度下降(Batch Gradient Descent) 这种方式在梯度下降的每一步中,我们都用到了所有的训练样本,也就是说,我们需要计算每一个 θj\theta_jθj 下损失函数的梯度,在梯度下降中,...

们深入讨论了逻辑回归中的关键优化技术——梯度下降,及其主要变体:批量梯度下降、随机梯度下降和小批量随机梯度下降。该文连接了系列前两篇文章的理论基础,解释了为何需要引入梯度下降等优化方法,并详细讲解了...

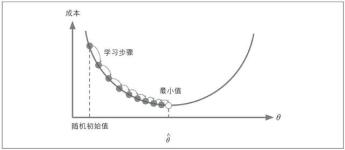

可以优化大量的机器学习模型,如线性回归、逻辑回归、神经网络等。梯度下降算法是一种通用的优化算法,适用于不同的损失函数。...梯度下降算法对于超参数的选择较为敏感,需要手动调整学习率、动量等参数。

在机器学习领域中,梯度下降的方式有三种,分别是:批量梯度下降法BGD、随机梯度下降法SGD、小批量梯度下降法MBGD,并且都有不同的优缺点。下面我们以线性回归算法(也可以是别的算法,只是损失函数(目标函数)不同...

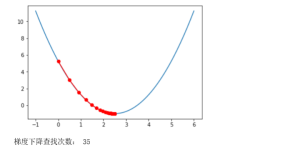

梯度下降是迭代法的一种,在求解机器学习算法的模型参数,即无约束优化问题时,梯度下降是最常采用的方法之一。在求解损失函数的最小值时,可以通过梯度下降法来一步步的迭代求解,得到最小化的损失函数和模型参数值...

神经网络的组成单元——神经元,神经元也叫做感知机。 在机器学习算法中,有时候需要对原始的模型构建损失函数,...而在求解机器学习参数的优化算法中,使用较多的就是基于梯度下降的优化算法(Gradient Descent, GD)。

梯度下降法及其常见变体介绍

如果我们定义了一个机器学习模型...,当损失函数值下降,我们就认为模型在拟合的路上又前进了一步。最终模型对训练数据集拟合的最好的情况是在损失函数值最小的时候,在指定数据集上时,为损失函数的平均值最小的时候。

梯度下降法,是当今最流行的优化(optimization)算法,亦是至今最常用的优化神经网络的方法。本文旨在让你对不同的优化梯度下降法的算法有一个直观认识,以帮助你使用这些算法。我们首先会考察梯度下降法的各种变体...

我们又要开始学习机器学习领域一个重要的方法—— 梯度下降法(Gradient Descent)。梯度下降法和我们之前学习的 kNN算法和线性回归算法不同,梯度下降法本身不是一个机器学习算法,它既不是在做监督学习也不是在做...

知道批梯度下降与MiniBatch梯度下降的区别 知道指数加权平均的意义 知道动量梯度、RMSProp、Adam算法的公式意义 知道学习率衰减方式 知道参数初始化策略的意义 应用 无 深度学习难以在大数据领域...

在机器学习领域,体梯度下降算法分为三种 - 批量梯度下降算法(BGD,Batch gradient descent algorithm) - 随机梯度下降算法(SGD,Stochastic gradient descent algorithm) - 小批量梯度下降算法(MBGD,Mini-...

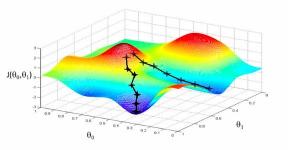

梯度下降是我们在机器学习中进行模型更新的一种常用方式,我们模型更新的目的往往是寻找最优解(对于凸函数而言)或者次优解,而对于高维的特征而言其过程往往是曲折的。 我们可以将寻找最优解的过程类比为...

像普通线性回归、Ridge回归,通过求导,也就是最小二乘法就可以求解,但Lasso不可以,Lasso通常采用...除了最小二乘法,还有另外一种方法,也是最常用的:梯度下降法。本文最后,也简要的介绍了一下牛顿法和拟牛顿法。

推荐文章

- 机器学习之超参数优化 - 网格优化方法(随机网格搜索)_网格搜索参数优化-程序员宅基地

- Lumina网络进入SDN市场-程序员宅基地

- python引用传递的区别_php传值引用的区别-程序员宅基地

- 《TCP/IP详解 卷2》 笔记: 简介_tcpip详解卷二有必要看吗-程序员宅基地

- 饺子播放器Jzvd使用过程中遇到的问题汇总-程序员宅基地

- python- flask current_app详解,与 current_app._get_current_object()的区别以及异步发送邮件实例-程序员宅基地

- 堪比ps的mac修图软件 Pixelmator Pro 2.0.6中文版 支持Silicon M1_pixelmator堆栈-程序员宅基地

- 「USACO2015」 最大流 - 树上差分_usaco 差分-程序员宅基地

- Leetcode #315: 计算右侧小于当前元素的个数_找元素右边比他小的数字-程序员宅基地

- HTTP图解读书笔记(第六章 HTTP首部)响应首部字段_web响应的首部内容-程序员宅基地