”爬虫必备知识详解“ 的搜索结果

python基基基础知识点

详解常见的HTTP状态码,并附上各状态码产生实例(提供图),能够帮助读者更加直观的理解状态码的产生过程

网页抓取更侧重于将网络上的非结构化数据(常见的是HTML格式)转换成为能...需要具备一定的前端知识,最起码应该能大概看懂网页内容,像基本的html元素,css样式,javascript等,不要求熟练掌握,这些是最基础的东西。

立即注册 xPython爬虫学习必备知识点:正则表达式模块详解-1.jpg (62.88 KB, 下载次数: 0)2020-11-17 09:36 上传想要学习Python。关注小编头条号,私信【学习资料】,即可免费领取一整套系统的板Python学习教程!一...

前言 试着用postman做完接口测试后,觉得工具做接口测试是非常便捷的。但是也存在着一定的不足和弊端。比如: 1. 敏捷开发,接口一般数量很大,团队实现接口测试,版本控制 2. 功能太死板,有些接口完全无法实现...

find_element_by_tag_name() | 通过标签名查找 (只有目标元素在当前html中是唯一标签或者是众多定位出来的标签中的第一个的时候才使用!driver.find_element_by_id(‘kw’).send_keys(‘猫咪图片’) 定位id属性值是...

python爬虫:XPath语法和使用示例 XPath(XML Path Language)是一门在XML文档中查找信息的语言,可以用来在XML文档中对元素和属性进行遍历。 很多人学习python,不知道从何学起。 很多人学习python,掌握了基本语法...

html超文本标记语言+css层叠样式表

详解HTTP状态码产生原理,理解HTTP请求和响应过程(提供图),描述请求头、响应头常用字段信息及理解。

① Python所有方向的学习路线图,清楚各个方向要学什么东西② 100多节Python课程视频,涵盖必备基础、爬虫和数据分析③ 100多个Python实战案例,学习不再是只会理论④ 华为出品独家Python漫画教程,手机也能学习⑤...

摘要:本文主要理清网络爬虫的概念,简要讲解爬虫的必备知识,分为python基础、字符编码、http头信息、http状态码、html基础、爬虫职业道德。内容浅显,主要理一理相关知识。一、网络爬虫的概念 网络爬虫,又被...

上面六个方法分别对应HTTP请求类型中的,各参数意义如下:url: 请求的URL地址.params: GET请求放进URL中的请求参数,以字典形式存储.data: 请求体中的数据.**kwargs: 该请求需要的其他参数,包括:headers: 以字典格式...

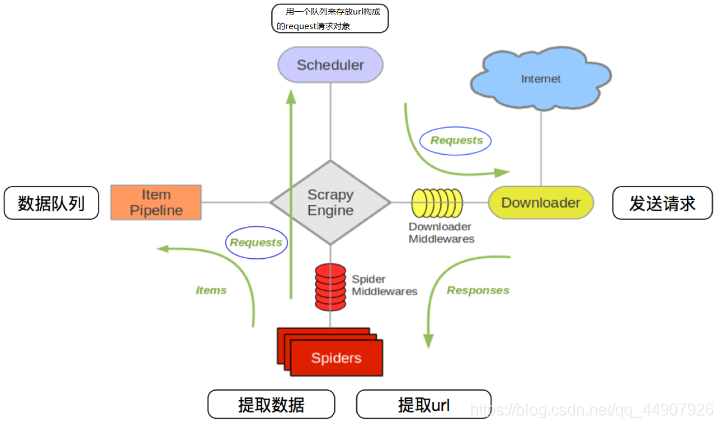

一: 什么是网络爬虫: 通俗理解:爬虫是一个模拟人类请求网站行为的程序。可以自动请求网页、并数据抓取下来...聚焦爬虫:是面向特定需求的一种网络爬虫程序,他与通用爬虫的区别在于:聚焦爬虫在实施网页抓取的时...

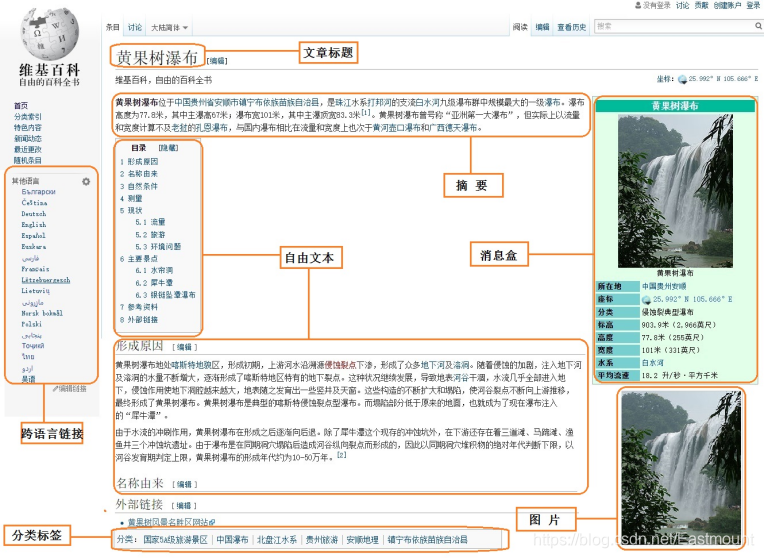

什么是爬虫 爬虫是做什么的?是帮助我们来快速获取有效信息的。然而做过爬虫的人都知道,解析是个麻烦事。比如一篇新闻吧,链接是这个: https://news.ifeng.com/c/7kQcQG2peWU,页面预览图如下: 我们需要从页面中...

https://blog.csdn.net/Eastmount/article/details/118147562

此外,requests 还提供了证书验证的功能。但是一旦开始大规模爬取,对于大规模且频繁的请求,网站可能会弹出验证码,或者跳转到登录认证页面,更甚者可能会直接封禁客户端的 IP,导致一定时间段内无法访问。...

从我们在浏览器地址栏输入网址敲下了回车之后到一个鲜活的网页呈现在我们面前这中间究竟发生了什么呢? ...DNS查询 DNS(Domain Name System,域名系统),万维网上作为域名和IP地址相互映射的一个分布式数据库,能够...

爬虫工程师需要具备哪些知识 一、必备部分(初级) 1、熟悉多线程编程、网络编程、HTTP协议相关 2、开发过完整爬虫项目(最好有全站爬虫经验,这个下面会说到) 3、反爬相关,cookie、ip池、验证码等等 4、熟练使用...

第一节 爬虫前奏 爬虫的实际例子: 搜索引擎(百度、谷歌、360搜索等)。 伯乐在线。 惠惠购物助手。 数据分析与研究(数据冰山知乎专栏)。 抢票软件等。 什么是网络爬虫: 通俗理解:爬虫是一个模拟人类...

导读:网络爬虫是一种很好的自动采集数据的通用手段。本文将会对爬虫的类型进行介绍。作者:赵国生 王健来源:大数据DT(ID:hzdashuju)聚焦网络爬虫是“面向特定主题需求”的一种爬虫程...

Robots协议也称作爬虫协议、机器人协议,它的全名是网络爬虫排除标准(Robots Exclusing Protocol),用来告诉爬虫和搜索引擎哪些页面可以抓取,哪些不可以抓取。该协议的内容通常放在一个名为robots.txt的文本文件...

推荐文章

- com.netflix.discovery.shared.transport.TransportException: Cannot execute request on any known serve-程序员宅基地

- PAT乙级练习题1010 一元多项式求导_pat 乙级 1010-程序员宅基地

- You can also run `php --ini` inside terminal to see which files are used by PH P in CLI mode_you can also run `php --ini` in a terminal to see -程序员宅基地

- 对UDP校验和的理解_udp 数据包 校验和 checksum=0-程序员宅基地

- 递归遍历文件夹,以c:/windows为例-程序员宅基地

- git 本地与远程的链接_git如何本地和网页链接-程序员宅基地

- ArrayList与HashMap遍历删除元素,HashMap与ArrayList的clone体修改之间影响_在arraylist和hashmap遍历的同时删除元素,可能会导致一些问题发生-程序员宅基地

- Chapter2-软件构造过程和生命周期_iterative and agile systems development lifecycle -程序员宅基地

- 4.6 浮动定位方式float_c语言中float的左右浮动属性示例-程序员宅基地

- OSS上传【下载乱码问题】_阿里云oss文件名乱码-程序员宅基地